1. はじめに¶

1.1. 対象読者と目的¶

『CLUSTERPRO X スタートアップガイド』は、CLUSTERPRO をはじめてご使用になるユーザの皆様を対象に、CLUSTERPRO の製品概要、クラスタシステム導入のロードマップ、他マニュアルの使用方法についてのガイドラインを記載します。また、最新の動作環境情報や制限事項などについても紹介します。

1.2. 本書の構成¶

「2. クラスタシステムとは?」:クラスタシステムおよび CLUSTERPRO の概要について説明します。

「3. CLUSTERPRO の使用方法」:クラスタシステムの使用方法および関連情報について説明します。

「4. CLUSTERPRO の動作環境」:導入前に確認が必要な最新情報について説明します。

1.3. CLUSTERPRO マニュアル体系¶

CLUSTERPRO のマニュアルは、以下の 6 つに分類されます。各ガイドのタイトルと役割を以下に示します。

『CLUSTERPRO X スタートアップガイド』 (Getting Started Guide)

すべてのユーザを対象読者とし、製品概要、動作環境、アップデート情報、既知の問題などについて記載します。

『CLUSTERPRO X インストール&設定ガイド』 (Install and Configuration Guide)

CLUSTERPRO を使用したクラスタシステムの導入を行うシステムエンジニアと、クラスタシステム導入後の保守・運用を行うシステム管理者を対象読者とし、CLUSTERPRO を使用したクラスタシステム導入から運用開始前までに必須の事項について説明します。実際にクラスタシステムを導入する際の順番に則して、CLUSTERPRO を使用したクラスタシステムの設計方法、CLUSTERPRO のインストールと設定手順、設定後の確認、運用開始前の評価方法について説明します。

『CLUSTERPRO X リファレンスガイド』 (Reference Guide)

管理者、および CLUSTERPRO を使用したクラスタシステムの導入を行うシステムエンジニアを対象とし、CLUSTERPRO の運用手順、各モジュールの機能説明およびトラブルシューティング情報等を記載します。『CLUSTERPRO X インストール&設定ガイド』を補完する役割を持ちます。

『CLUSTERPRO X メンテナンスガイド』 (Maintenance Guide)

管理者、および CLUSTERPRO を使用したクラスタシステム導入後の保守・運用を行うシステム管理者を対象読者とし、CLUSTERPRO のメンテナンス関連情報を記載します。

『CLUSTERPRO X ハードウェア連携ガイド』 (Hardware Feature Guide)

管理者、および CLUSTERPRO を使用したクラスタシステムの導入を行うシステムエンジニアを対象読者とし、特定ハードウェアと連携する機能について記載します。『CLUSTERPRO X インストール&設定ガイド』を補完する役割を持ちます。

『CLUSTERPRO X 互換機能ガイド』 (Legacy Feature Guide)

管理者、および CLUSTERPRO を使用したクラスタシステムの導入を行うシステムエンジニアを対象読者とし、CLUSTERPRO X 4.0 WebManager および Builder に関する情報について記載します。

1.4. 本書の表記規則¶

本書では、注意すべき事項、重要な事項および関連情報を以下のように表記します。

注釈

この表記は、重要ではあるがデータ損失やシステムおよび機器の損傷には関連しない情報を表します。

重要

この表記は、データ損失やシステムおよび機器の損傷を回避するために必要な情報を表します。

参考

この表記は、参照先の情報の場所を表します。

また、本書では以下の表記法を使用します。

表記 |

使用方法 |

例 |

|---|---|---|

[ ] 角かっこ |

コマンド名の前後

画面に表示される語(ダイアログボックス、メニューなど)の前後

|

[スタート]をクリックします。

[プロパティ]ダイアログ ボックス

|

コマンドライン中の [ ] 角かっこ |

かっこ内の値の指定が省略可能であることを示します。 |

|

モノスペースフォント |

パス名、コマンドライン、システムからの出力(メッセージ、プロンプトなど)、ディレクトリ、ファイル名、関数、パラメータ |

|

太字 |

ユーザが実際にコマンドプロンプトから入力する値を示します。 |

以下を入力します。

clpcl -s -a

|

|

ユーザが有効な値に置き換えて入力する項目 |

|

本書の図では、CLUSTERPROを表すために このアイコンを使用します。

本書の図では、CLUSTERPROを表すために このアイコンを使用します。

2. クラスタシステムとは?¶

本章では、クラスタシステムの概要について説明します。

本章で説明する項目は以下のとおりです。

2.1. クラスタシステムの概要¶

現在のコンピュータ社会では、サービスを停止させることなく提供し続けることが成功への重要なカギとなります。例えば、1 台のマシンが故障や過負荷によりダウンしただけで、顧客へのサービスが全面的にストップしてしまうことがあります。そうなると、莫大な損害を引き起こすだけではなく、顧客からの信用を失いかねません。

このような事態に備えるのがクラスタシステムです。クラスタシステムを導入することにより、万一のときのシステム稼働停止時間 (ダウンタイム) を最小限に食い止めたり、負荷を分散させたりすることでシステムダウンを回避することが可能になります。

クラスタとは、「群れ」「房」を意味し、その名の通り、クラスタシステムとは「複数のコンピュータを一群 (または複数群) にまとめて、信頼性や処理性能の向上を狙うシステム」です。クラスタシステムには様々な種類があり、以下の 3 つに分類できます。この中で、CLUSTERPRO は HA(High Availability) クラスタに分類されます。

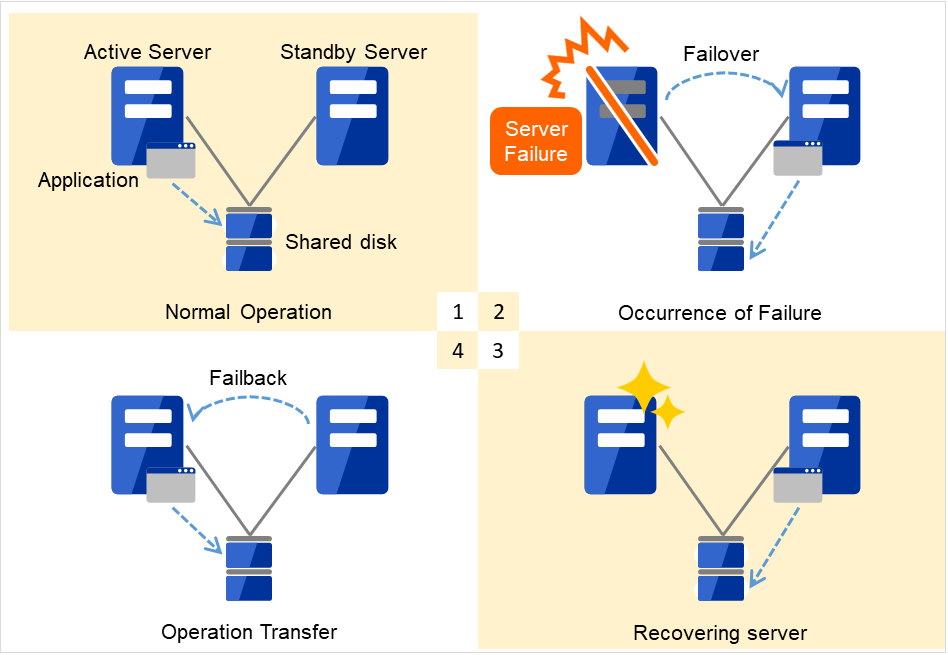

HA (High Availability) クラスタ

通常時は一方が現用系として業務を提供し、現用系障害発生時に待機系に業務を引き継ぐような形態のクラスタです。高可用性を目的としたクラスタで、データの引継ぎも可能です。共有ディスク型、データミラー型、遠隔クラスタがあります。

負荷分散クラスタ

クライアントからの要求を適切な負荷分散ルールに従って負荷分散ホストに要求を割り当てるクラスタです。高スケーラビリティを目的としたクラスタで、一般的にデータの引継ぎはできません。ロードバランスクラスタ、並列データベースクラスタがあります。

HPC (High Performance Computing) クラスタ

全てのノードの CPU を利用し、単一の業務を実行するためのクラスタです。高性能化を目的としており、あまり汎用性はありません。なお、HPC の 1 つであり、より広域な範囲のノードや計算機クラスタまでを束ねた、グリッドコンピューティングという技術も近年話題に上ることが多くなっています。

2.2. HA (High Availability) クラスタ¶

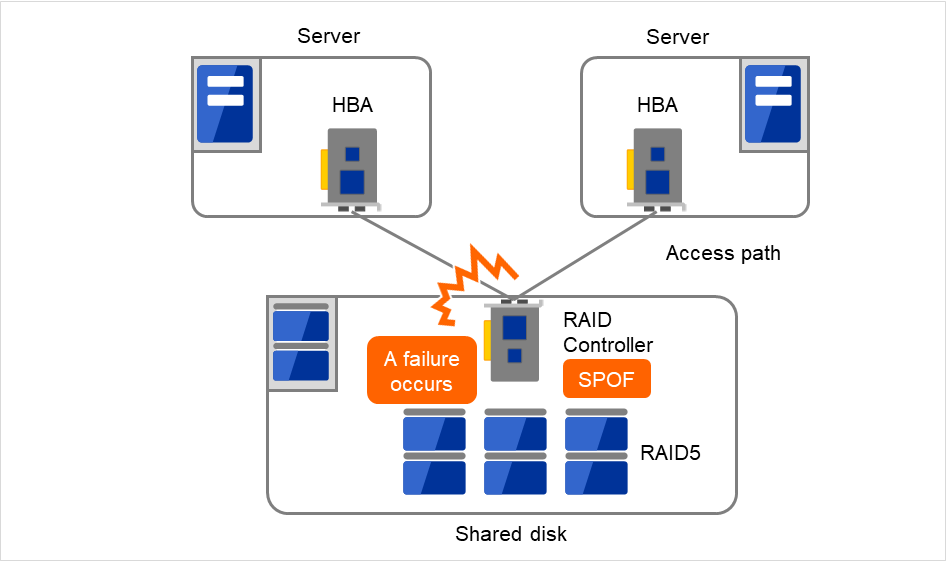

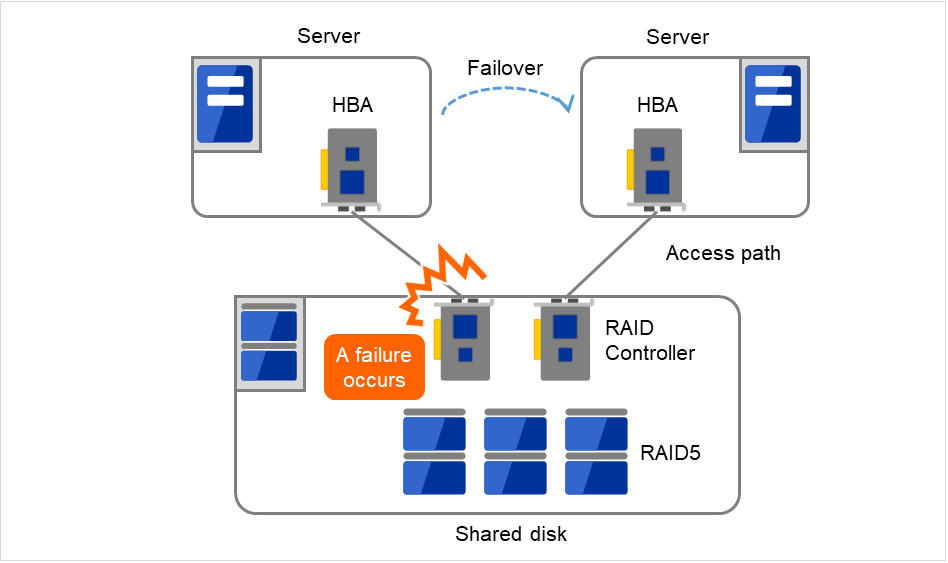

一般的にシステムの可用性を向上させるには、そのシステムを構成する部品を冗長化し、Single Point of Failure をなくすことが重要であると考えられます。Single Point of Failure とは、コンピュータの構成要素 (ハードウェアの部品) が 1 つしかないために、その箇所で障害が起きると業務が止まってしまう弱点のことを指します。HA クラスタとは、サーバを複数台使用して冗長化することにより、システムの停止時間を最小限に抑え、業務の可用性(availability) を向上させるクラスタシステムをいいます。

システムの停止が許されない基幹業務システムはもちろん、ダウンタイムがビジネスに大きな影響を与えてしまうそのほかのシステムにおいても、HA クラスタの導入が求められています。

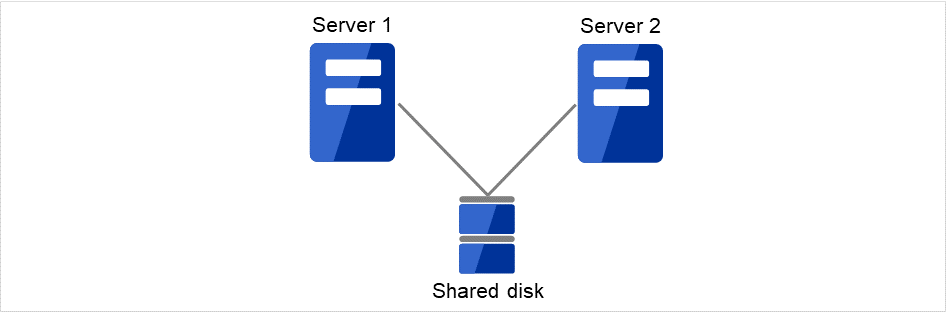

HA クラスタは、共有ディスク型とデータミラー型に分けることができます。以下にそれぞれのタイプについて説明します。

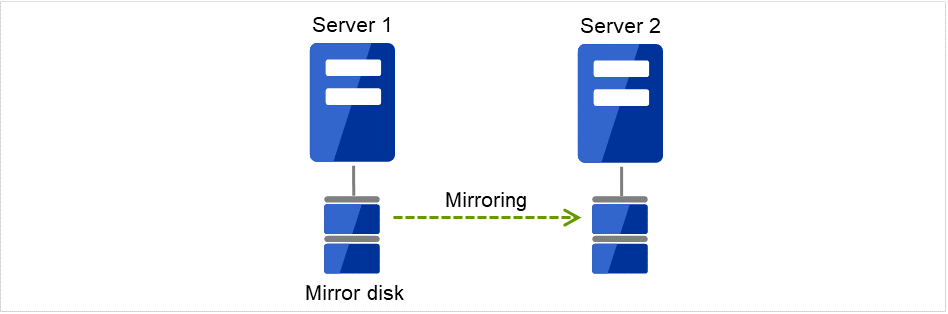

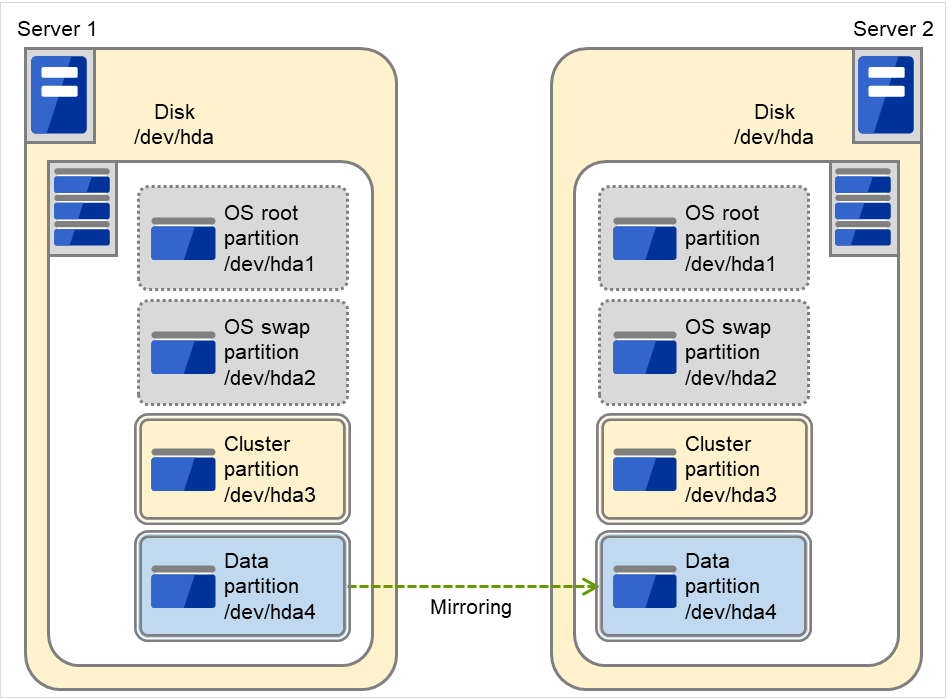

2.2.2. データミラー型¶

前述の共有ディスク型は大規模なシステムに適していますが、共有ディスクはおおむね高価なためシステム構築のコストが膨らんでしまいます。そこで共有ディスクを使用せず、各サーバのディスクをサーバ間でミラーリングすることにより、同じ機能をより低価格で実現したクラスタシステムをデータミラー型といいます。

図 2.5 HAクラスタ構成図(データミラー型)¶

共有ディスクが不要なので安価

ミラーリングのためデータ量が多くないシステム向き

しかし、サーバ間でデータをミラーリングする必要があるため、大量のデータを必要とする大規模システムには向きません。

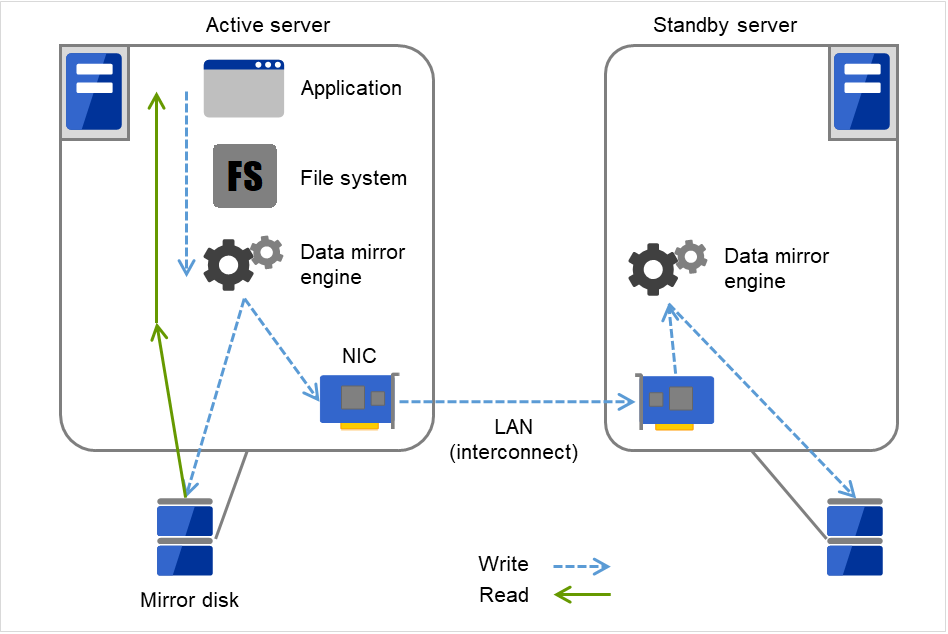

アプリケーションからの Write 要求が発生すると、データミラーエンジンはローカルディスクにデータを書き込むと同時に、インタコネクトを通して待機系サーバにも Write 要求を振り分けます。インタコネクトとは、サーバ間をつなぐネットワークのことで、クラスタシステムではサーバの死活監視のために必要になります。データミラータイプでは死活監視に加えてデータの転送に使用することがあります。待機系のデータミラーエンジンは、受け取ったデータを待機系のローカルディスクに書き込むことで、現用系と待機系間のデータを同期します。

アプリケーションからのRead要求に対しては、単に現用系のディスクから読み出すだけです。

図 2.6 データミラーの仕組み¶

データミラーの応用例として、スナップショットバックアップの利用があります。データミラータイプのクラスタシステムは2カ所に共有のデータを持っているため、待機系のサーバをクラスタから切り離すだけで、バックアップ時間をかけることなくスナップショットバックアップとしてディスクを保存する運用が可能です。

フェイルオーバの仕組みと問題点

ここまで、一口にクラスタシステムといってもフェイルオーバクラスタ、負荷分散クラスタ、HPC (High Performance Computing) クラスタなど、さまざまなクラスタシステムがあることを説明しました。そして、フェイルオーバクラスタはHA (High Availability) クラスタと呼ばれ、サーバそのものを多重化することで、障害発生時に実行していた業務をほかのサーバで引き継ぐことにより、業務の可用性 (Availability) を向上することを目的としたクラスタシステムであることを見てきました。次に、クラスタの実装と問題点について説明します。

2.3. 障害検出のメカニズム¶

クラスタソフトウェアは、業務継続に問題をきたす障害を検出すると業務の引き継ぎ (フェイルオーバ) を実行します。フェイルオーバ処理の具体的な内容に入る前に、簡単にクラスタソフトウェアがどのように障害を検出するか見ておきましょう。

ハートビートとサーバの障害検出

クラスタシステムにおいて、検出すべき最も基本的な障害はクラスタを構成するサーバ全てが停止してしまうものです。サーバの障害には、電源異常やメモリエラーなどのハードウェア障害や OS のパニックなどが含まれます。このような障害を検出するために、サーバの死活監視としてハートビートが使用されます。

ハートビートは、ping の応答を確認するような死活監視だけでもよいのですが、クラスタソフトウェアによっては、自サーバの状態情報などを相乗りさせて送るものもあります。クラスタソフトウェアはハートビートの送受信を行い、ハートビートの応答がない場合はそのサーバの障害とみなしてフェイルオーバ処理を開始します。ただし、サーバの高負荷などによりハートビートの送受信が遅延することも考慮し、サーバ障害と判断するまである程度の猶予時間が必要です。このため、実際に障害が発生した時間とクラスタソフトウェアが障害を検知する時間とにはタイムラグが生じます。

リソースの障害検出

業務の停止要因はクラスタを構成するサーバ全ての停止だけではありません。例えば、業務アプリケーションが使用するディスク装置や NIC の障害、もしくは業務アプリケーションそのものの障害などによっても業務は停止してしまいます。可用性を向上するためには、このようなリソースの障害も検出してフェイルオーバを実行しなければなりません。

リソース異常を検出する手法として、監視対象リソースが物理的なデバイスの場合は、実際にアクセスしてみるという方法が取られます。アプリケーションの監視では、アプリケーションプロセスそのものの死活監視のほか、業務に影響のない範囲でサービスポートを試してみるような手段も考えられます。

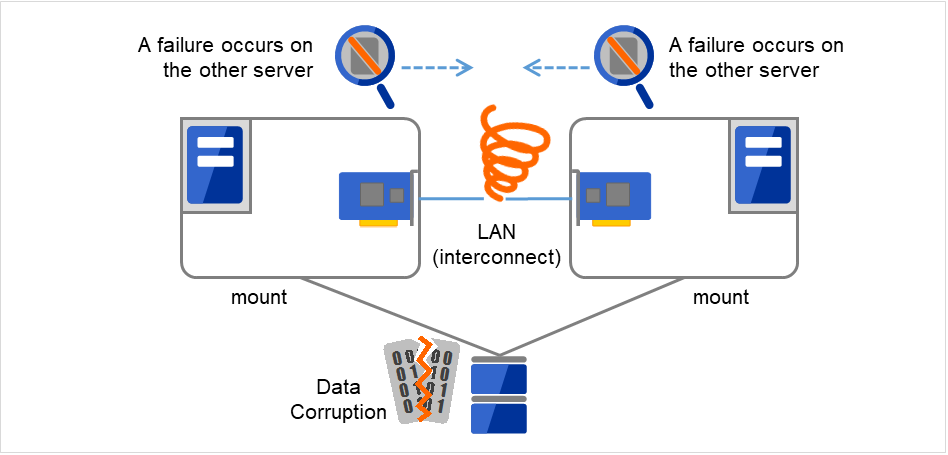

2.3.2. ネットワークパーティション症状 (Split-brain-syndrome)¶

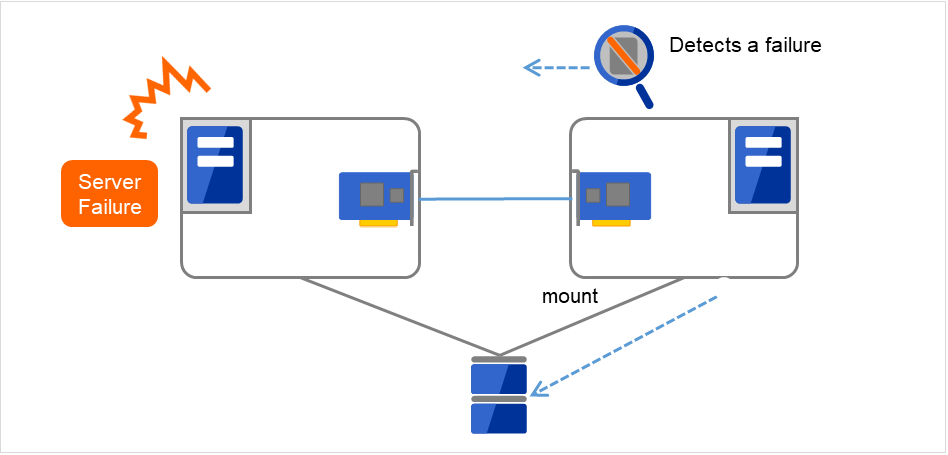

サーバ間をつなぐすべてのインタコネクトが切断されると、ハートビートによる死活監視で互いに相手サーバのダウンを検出し、フェイルオーバ処理を実行してしまいます。結果として、複数のサーバでファイルシステムを同時にマウントしてしまい、データ破壊を引き起こします。フェイルオーバクラスタシステムでは異常が発生したときに適切に動作しなければならないことが理解できると思います。

図 2.8 ネットワークパーティション症状¶

このような問題を「ネットワークパーティション症状」またはスプリットブレインシンドローム(Split-brain-syndrome) と呼びます。フェイルオーバクラスタでは、すべてのインタコネクトが切断されたときに、確実に共有ディスク装置の排他制御を実現するためのさまざまな対応策が考えられています。

2.4. クラスタリソースの引き継ぎ¶

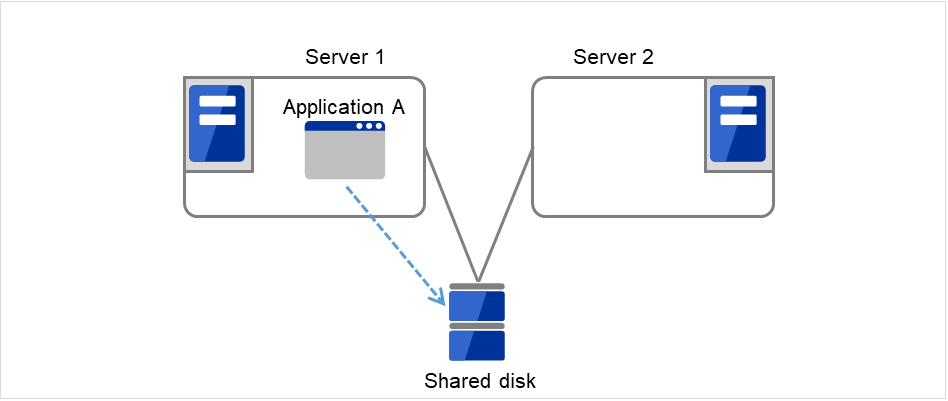

クラスタが管理するリソースにはディスク、IP アドレス、アプリケーションなどがあります。これらのクラスタリソースを引き継ぐための、フェイルオーバクラスタシステムの機能について説明します。

2.4.1. データの引き継ぎ¶

クラスタシステムでは、サーバ間で引き継ぐデータは共有ディスク装置上のパーティションに格納します。すなわち、データを引き継ぐとは、アプリケーションが使用するファイルが格納されているファイルシステムを健全なサーバ上でマウントしなおすことにほかなりません。共有ディスク装置は引き継ぐ先のサーバと物理的に接続されているので、クラスタソフトウェアが行うべきことはファイルシステムのマウントだけです。

図 2.9 データの引き継ぎ¶

単純な話のようですが、クラスタシステムを設計・構築するうえで注意しなければならない点があります。

1 つは、ファイルシステムの復旧時間の問題です。引き継ごうとしているファイルシステムは、障害が発生する直前までほかのサーバで使用され、もしかしたらまさに更新中であったかもしれません。このため、引き継ぐファイルシステムは通常ダーティであり、ファイルシステムの整合性チェックが必要な状態となっています。ファイルシステムのサイズが大きくなると、整合性チェックに必要な時間は莫大になり、場合によっては数時間もの時間がかかってしまいます。それがそのままフェイルオーバ時間 (業務の引き継ぎ時間) に追加されてしまい、システムの可用性を低下させる要因になります。

もう 1 つは、書き込み保証の問題です。アプリケーションが大切なデータをファイルに書き込んだ場合、同期書き込みなどを利用してディスクへの書き込みを保証しようとします。ここでアプリケーションが書き込んだと思い込んだデータは、フェイルオーバ後にも引き継がれていることが期待されます。例えばメールサーバは、受信したメールをスプールに確実に書き込んだ時点で、クライアントまたはほかのメールサーバに受信完了を応答します。これによってサーバ障害発生後も、スプールされているメールをサーバの再起動後に再配信することができます。クラスタシステムでも同様に、一方のサーバがスプールへ書き込んだメールはフェイルオーバ後にもう一方のサーバが読み込めることを保証しなければなりません。

2.4.2. アプリケーションの引き継ぎ¶

クラスタソフトウェアが業務引き継ぎの最後に行う仕事は、アプリケーションの引き継ぎです。フォールトトレラントコンピュータ (FTC) とは異なり、一般的なフェイルオーバクラスタでは、アプリケーション実行中のメモリ内容を含むプロセス状態などを引き継ぎません。すなわち、障害が発生していたサーバで実行していたアプリケーションを健全なサーバで再実行することでアプリケーションの引き継ぎを行います。

例えば、データベース管理システム (DBMS) のインスタンスを引き継ぐ場合、インスタンスの起動時に自動的にデータベースの復旧 (ロールフォワード / ロールバックなど) が行われます。このデータベース復旧に必要な時間は、DBMS のチェックポイントインターバルの設定などによってある程度の制御ができますが、一般的には数分程度必要となるようです。

多くのアプリケーションは再実行するだけで業務を再開できますが、障害発生後の業務復旧手順が必要なアプリケーションもあります。このようなアプリケーションのためにクラスタソフトウェアは業務復旧手順を記述できるよう、アプリケーションの起動の代わりにスクリプトを起動できるようになっています。スクリプト内には、スクリプトの実行要因や実行サーバなどの情報をもとに、必要に応じて更新途中であったファイルのクリーンアップなどの復旧手順を記述します。

2.5. Single Point of Failureの排除¶

高可用性システムを構築するうえで、求められるもしくは目標とする可用性のレベルを把握することは重要です。これはすなわち、システムの稼働を阻害し得るさまざまな障害に対して、冗長構成をとることで稼働を継続したり、短い時間で稼働状態に復旧したりするなどの施策を費用対効果の面で検討し、システムを設計するということです。

Single Point of Failure (SPOF) とは、システム停止につながる部位を指す言葉であると前述しました。クラスタシステムではサーバの多重化を実現し、システムの SPOF を排除することができますが、共有ディスクなど、サーバ間で共有する部分については SPOF となり得ます。この共有部分を多重化もしくは排除するようシステム設計することが、高可用性システム構築の重要なポイントとなります。

クラスタシステムは可用性を向上させますが、フェイルオーバには数分程度のシステム切り替え時間が必要となります。従って、フェイルオーバ時間は可用性の低下要因の 1 つともいえます。このため、高可用性システムでは、まず単体サーバの可用性を高める ECC メモリや冗長電源などの技術が本来重要なのですが、ここでは単体サーバの可用性向上技術には触れず、クラスタシステムにおいて SPOF となりがちな下記の 3 つについて掘り下げて、どのような対策があるか見ていきたいと思います。

共有ディスク

共有ディスクへのアクセスパス

LAN

2.5.3. LAN¶

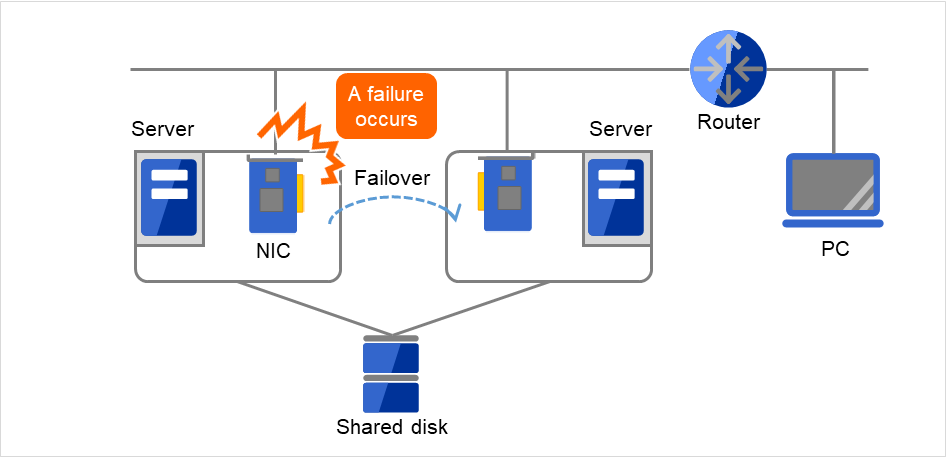

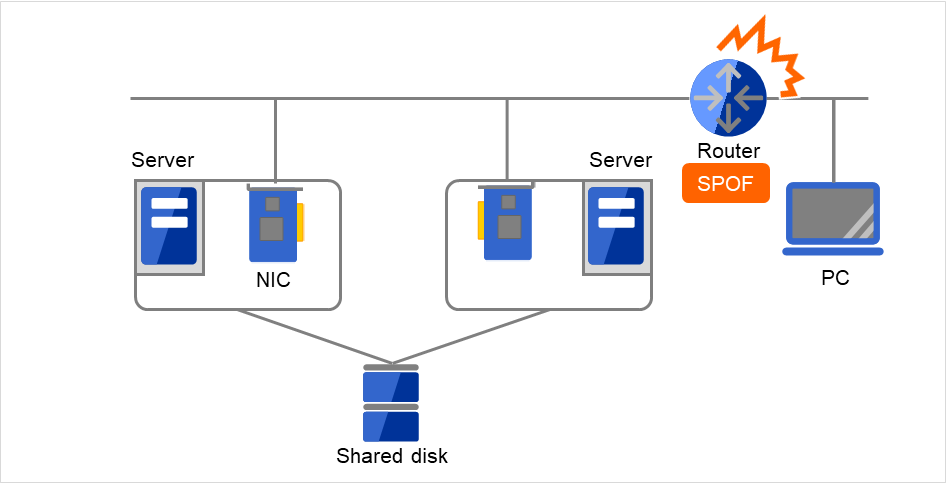

クラスタシステムに限らず、ネットワーク上で何らかのサービスを実行するシステムでは、LANの障害はシステムの稼働を阻害する大きな要因です。クラスタシステムでは適切な設定を行えば NIC 障害時にノード間でフェイルオーバを発生させて可用性を高めることは可能ですが、クラスタシステムの外側のネットワーク機器が故障した場合はやはりシステムの稼働を阻害します。

図 2.14 LANにおける障害の例(NIC)¶

この図の場合、Server上のNICが故障してもフェイルオーバすることで、Server上のサービスに対するPCからのアクセスを継続できます。

図 2.15 LANにおける障害の例(ルータ)¶

この図の場合、Routerが故障するとServer上のサービスに対するPCからのアクセスを継続できません(RouterがSPOFになっている)。

このようなケースでは、LAN を冗長化することでシステムの可用性を高めます。クラスタシステムにおいても、LAN の可用性向上には単体サーバでの技術がそのまま利用可能です。例えば、予備のネットワーク機器の電源を入れずに準備しておき、故障した場合に手動で入れ替えるといった原始的な手法や、高機能のネットワーク機器を冗長配置してネットワーク経路を多重化することで自動的に経路を切り替える方法が考えられます。また、インテル社の ANS ドライバのようにNICの冗長構成をサポートするドライバを利用するということも考えられます。

ロードバランス装置 (Load Balance Appliance) やファイアウォールサーバ (Firewall Appliance) も SPOF となりやすいネットワーク機器です。これらもまた、標準もしくはオプションソフトウェアを利用することで、フェイルオーバ構成を組めるようになっているのが普通です。同時にこれらの機器は、システム全体の非常に重要な位置に存在するケースが多いため、冗長構成をとることはほぼ必須と考えるべきです。

2.6. 可用性を支える運用¶

2.6.1. 運用前評価¶

システムトラブルの発生要因の多くは、設定ミスや運用保守に起因するものであるともいわれています。このことから考えても、高可用性システムを実現するうえで運用前の評価と障害復旧マニュアルの整備はシステムの安定稼働にとって重要です。評価の観点としては、実運用に合わせて、次のようなことを実践することが可用性向上のポイントとなります。

障害発生箇所を洗い出し、対策を検討し、擬似障害評価を行い実証する

クラスタのライフサイクルを想定した評価を行い、縮退運転時のパフォーマンスなどの検証を行う

これらの評価をもとに、システム運用、障害復旧マニュアルを整備する

クラスタシステムの設計をシンプルにすることは、上記のような検証やマニュアルが単純化でき、システムの可用性向上のポイントとなることが分かると思います。

2.6.2. 障害監視¶

上記のような努力にもかかわらず障害は発生するものです。ハードウェアには経年劣化があり、ソフトウェアにはメモリリークなどの理由や設計当初のキャパシティプラニングを超えた運用をしてしまうことによる障害など、長期間運用を続ければ必ず障害が発生してしまいます。このため、ハードウェア、ソフトウェアの可用性向上と同時に、さらに重要となるのは障害を監視して障害発生時に適切に対処することです。万が一サーバに障害が発生した場合を例に取ると、クラスタシステムを組むことで数分の切り替え時間でシステムの稼働を継続できますが、そのまま放置しておけばシステムは冗長性を失い次の障害発生時にはクラスタシステムは何の意味もなさなくなってしまいます。

このため、障害が発生した場合、すぐさまシステム管理者は次の障害発生に備え、新たに発生した SPOF を取り除くなどの対処をしなければなりません。このようなシステム管理業務をサポートするうえで、リモートメンテナンスや障害の通報といった機能が重要になります。Linuxでは、リモートメンテナンスの面ではいうまでもなく非常に優れていますし、障害を通報する仕組みも整いつつあります。

以上、クラスタシステムを利用して高可用性を実現するうえで必要とされる周辺技術やそのほかのポイントについて説明しました。簡単にまとめると次のような点に注意しましょうということになるかと思います。

Single Point of Failure を排除または把握する

障害に強いシンプルな設計を行い、運用前評価に基づき運用・障害復旧手順のマニュアルを整備する

発生した障害を早期に検出し適切に対処する

3. CLUSTERPRO の使用方法¶

本章では、CLUSTERPRO を構成するコンポーネントの説明と、クラスタシステムの設計から運用手順までの流れについて説明します。

本章で説明する項目は以下のとおりです。

3.1. CLUSTERPRO とは?¶

クラスタについて理解したところで、CLUSTERPRO の紹介を始めましょう。CLUSTERPRO とは、冗長化 (クラスタ化) したシステム構成により、現用系のサーバでの障害が発生した場合に、自動的に待機系のサーバで業務を引き継がせることで、飛躍的にシステムの可用性と拡張性を高めることを可能にするソフトウェアです。

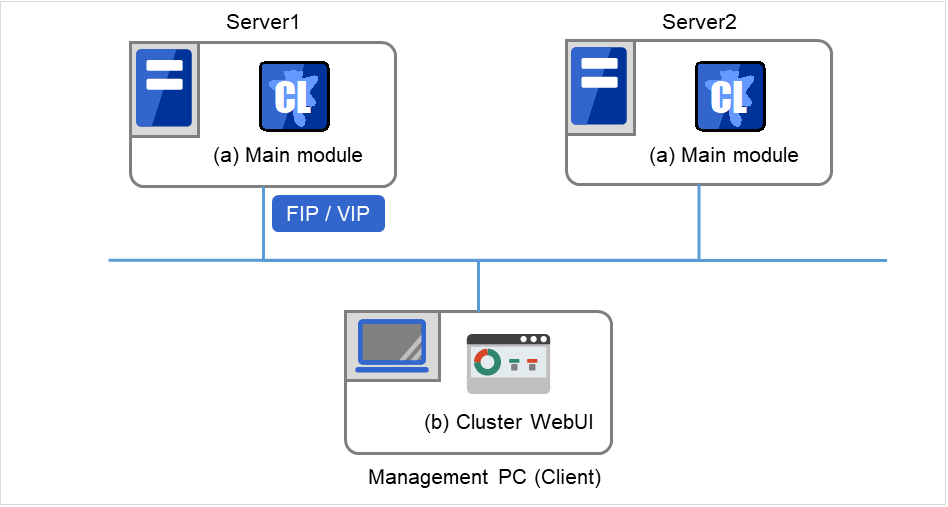

3.2. CLUSTERPRO の製品構成¶

CLUSTERPRO は大きく分けると 2 つのモジュールから構成されています。

- CLUSTERPRO ServerCLUSTERPRO の本体で、サーバの高可用性機能の全てが包含されています。また、Cluster WebUI のサーバ側機能も含まれます。

- Cluster WebUICLUSTERPRO の構成情報の作成や運用管理を行うための管理ツールです。ユーザインターフェイスとして Web ブラウザを利用します。実体は CLUSTERPRO Server に組み込まれていますが、操作は管理端末上の Web ブラウザで行うため、CLUSTERPRO Server 本体とは区別されています。

3.3. CLUSTERPRO のソフトウェア構成¶

CLUSTERPRO のソフトウェア構成は次の図のようになります。Linux サーバ上には「CLUSTERPRO Server (CLUSTERPRO本体)」をインストールします。Cluster WebUI の本体機能は CLUSTERPRO Server に含まれるため、別途インストールする必要がありません。Cluster WebUI は管理 PC 上の Web ブラウザから利用するほか、クラスタを構成する各サーバ上の Web ブラウザでも利用できます。

CLUSTERPRO Server

Cluster WebUI

図 3.1 CLUSTERPRO のソフトウェア構成¶

3.3.1. CLUSTERPRO の障害監視のしくみ¶

CLUSTERPRO では、サーバ監視、業務監視、内部監視の 3 つの監視を行うことで、迅速かつ確実な障害検出を実現しています。以下にその監視の詳細を示します。

3.3.2. サーバ監視とは¶

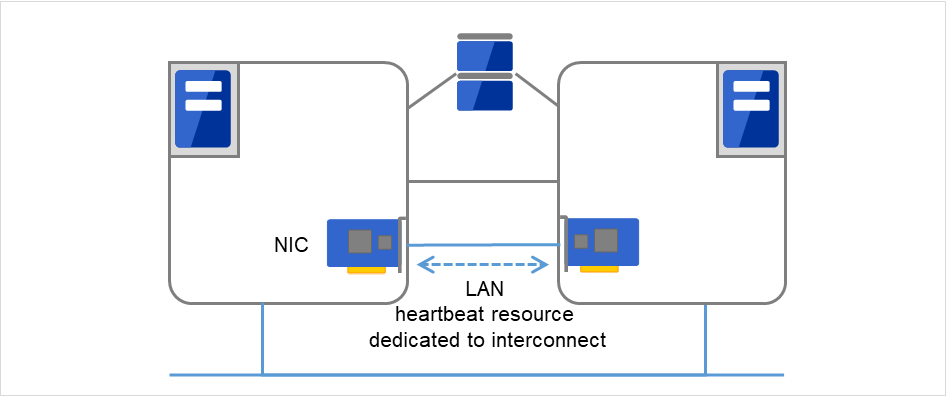

- プライマリインタコネクトフェイルオーバ型クラスタ専用の通信パスで、一般の Ethernet NIC を使用します。ハートビートを行うと同時にサーバ間の情報交換に使用します。

図 3.2 LANハートビート/カーネルモードLANハートビート(プライマリインタコネクト)¶

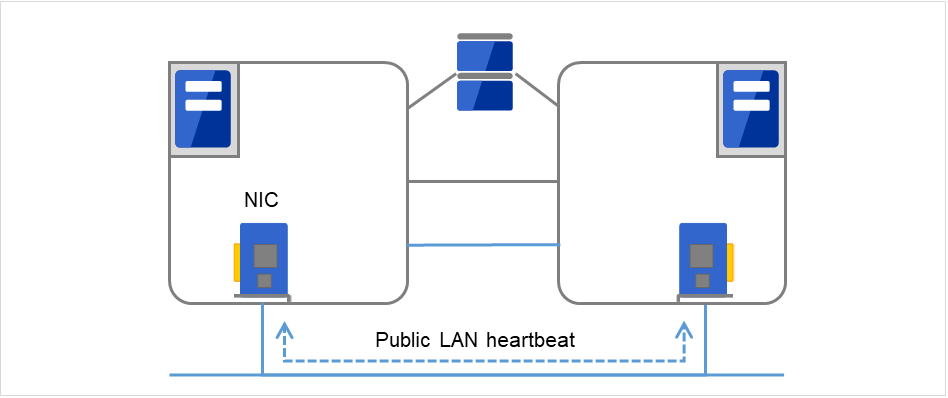

- セカンダリインタコネクトクライアントとの通信に使用している通信パスを予備のインタコネクトとして使用します。TCP/IP が使用できる NIC であればどのようなものでも構いません。ハートビートを行うと同時にサーバ間の情報交換に使用します。

図 3.3 LANハートビート/カーネルモードLANハートビート(セカンダリインタコネクト)¶

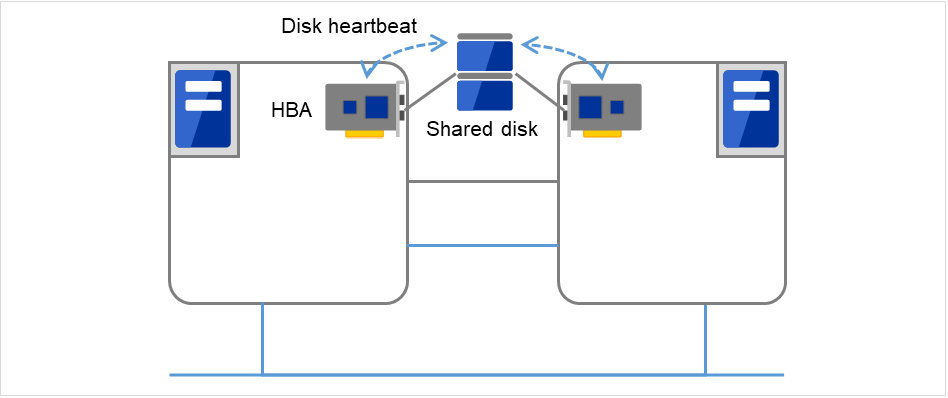

- 共有ディスクフェイルオーバ型クラスタを構成する全てのサーバに接続されたディスク上に、CLUSTERPRO 専用のパーティション (CLUSTERパーティション) を作成し、CLUSTER パーティション上でハートビートを行います。

図 3.4 ディスクハートビート¶

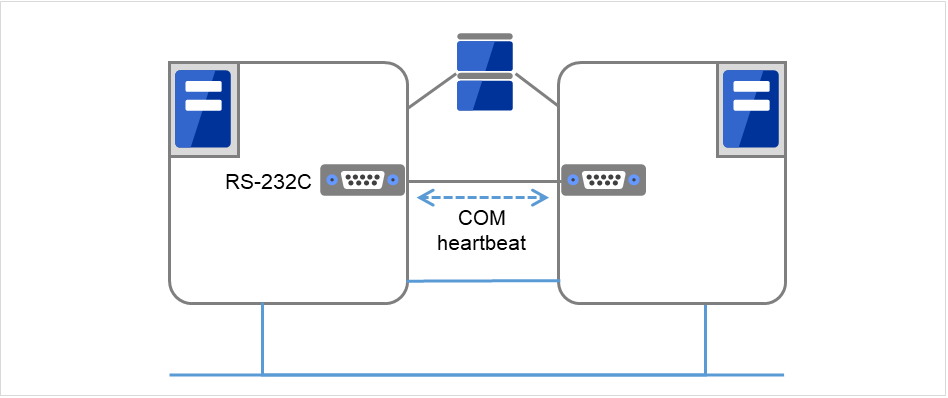

- COM ポートフェイルオーバ型クラスタを構成するサーバ間を、COM ポートを介してハートビート通信を行い、他サーバの生存を確認します。

図 3.5 COMハートビート¶

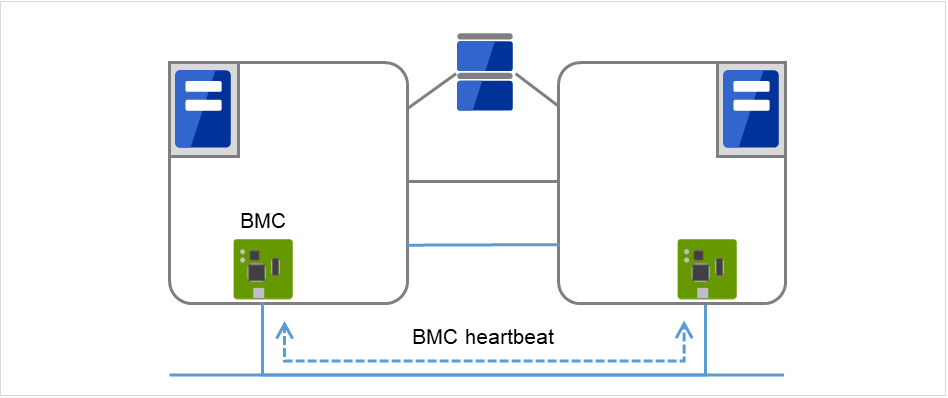

- BMCフェイルオーバ型クラスタを構成するサーバ間を、BMC を介してハートビート通信を行い、他サーバの生存を確認します。

図 3.6 BMCハートビート¶

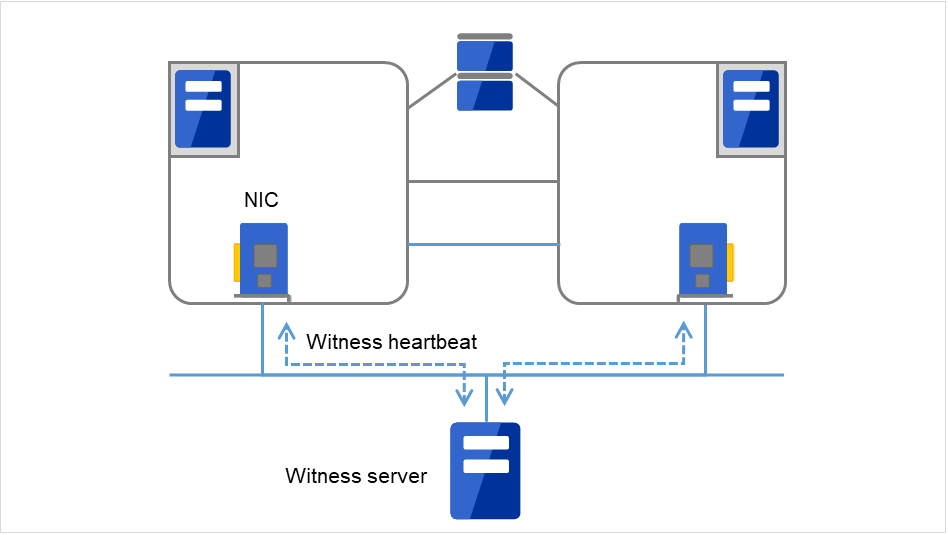

- Witnessフェイルオーバ型クラスタを構成する各サーバとWitness サーバサービスが動作している外部サーバ (Witness サーバ) 間で通信を行い、Witness サーバが保持する他サーバとの通信情報から生存を確認します。

図 3.7 Witnessハートビート¶

注釈

ネットワークパーティション状態について:クラスタサーバ間の全ての通信路に障害が発生しネットワーク的に分断されてしまう状態のことです。ネットワークパーティション状態に対応できていないクラスタシステムでは、通信路の障害とサーバの障害を区別できず、同一資源を複数のサーバからアクセスしデータ破壊を引き起こす場合があります。

3.3.3. 業務監視とは¶

業務監視とは、業務アプリケーションそのものや業務が実行できない状態に陥る障害要因を監視する機能です。

- アプリケーションの死活監視アプリケーションを起動用のリソース (EXEC リソースと呼びます) により起動を行い、監視用のリソース (PID モニタリソースと呼びます) により定期的にプロセスの生存を確認することで実現します。業務停止要因が業務アプリケーションの異常終了である場合に有効です。

注釈

CLUSTERPRO が直接起動したアプリケーションが監視対象の常駐プロセスを起動し終了してしまうようなアプリケーションでは、常駐プロセスの異常を検出することはできません。

アプリケーションの内部状態の異常 (アプリケーションのストールや結果異常) を検出することはできません。

- リソースの監視CLUSTERPRO のモニタリソースによりクラスタリソース (ディスクパーティション、IP アドレスなど) やパブリック LAN の状態を監視することで実現します。業務停止要因が業務に必要なリソースの異常である場合に有効です。

3.3.4. 内部監視とは¶

CLUSTERPRO プロセスの死活監視

3.3.5. 監視できる障害と監視できない障害¶

CLUSTERPRO には、監視できる障害とできない障害があります。クラスタシステム構築時、運用時に、どのような監視が検出可能なのか、または検出できないのかを把握しておくことが重要です。

3.3.6. サーバ監視で検出できる障害とできない障害¶

監視条件: 障害サーバからのハートビートが途絶

監視できる障害の例

ハードウェア障害 (OS が継続動作できないもの)

panic

監視できない障害の例

OS の部分的な機能障害 (マウス/キーボードのみが動作しない等)

3.3.7. 業務監視で検出できる障害とできない障害¶

監視条件: 障害アプリケーションの消滅、 継続的なリソース異常、 あるネットワーク装置への通信路切断

監視できる障害の例

アプリケーションの異常終了

共有ディスクへのアクセス障害 (HBA 1 の故障など)

パブリック LAN NIC の故障

監視できない障害の例

アプリケーションのストール/結果異常

アプリケーションのストール/結果異常を CLUSTERPRO で直接監視することはできませんが、アプリケーションを監視し異常検出時に自分自身を終了するプログラムを作成し、そのプログラムを EXEC リソースで起動、PID モニタリソースで監視することで、フェイルオーバを発生させることは可能です。

- 1

Host Bus Adapterの略で、共有ディスク側ではなく、サーバ本体側のアダプタのことです。

3.4. ネットワークパーティション解決¶

ping 方式

http 方式

参考

ネットワークパーティション解決方法の設定についての詳細は、『リファレンスガイド』の「ネットワークパーティション解決リソースの詳細」を参照してください。

3.5. フェイルオーバのしくみ¶

CLUSTERPRO は障害を検出すると、フェイルオーバ開始前に検出した障害がサーバの障害かネットワークパーティション状態かを判別します。この後、健全なサーバ上で各種リソースを活性化し業務アプリケーションを起動することでフェイルオーバを実行します。

このとき、同時に移動するリソースの集まりをフェイルオーバグループと呼びます。フェイルオーバグループは利用者から見た場合、仮想的なコンピュータとみなすことができます。

注釈

クラスタシステムでは、アプリケーションを健全なノードで起動しなおすことでフェイルオーバを実行します。このため、アプリケーションのメモリ上に格納されている実行状態をフェイルオーバすることはできません。

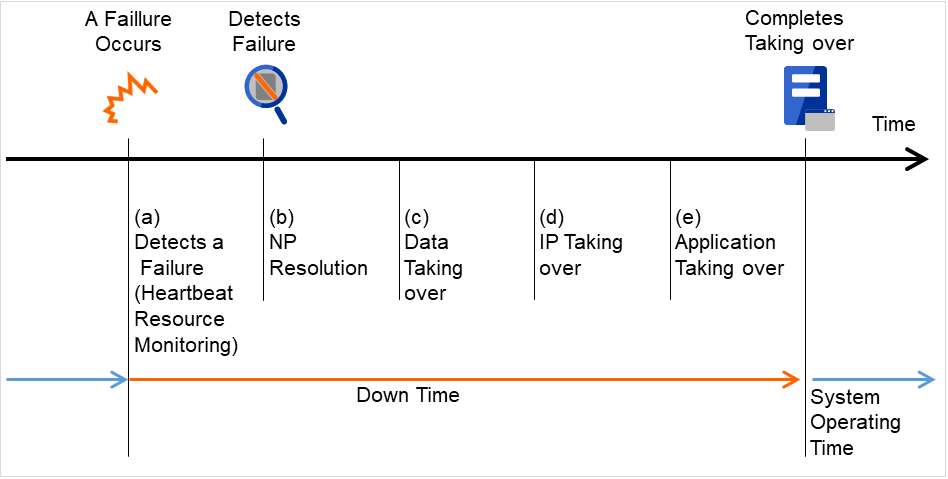

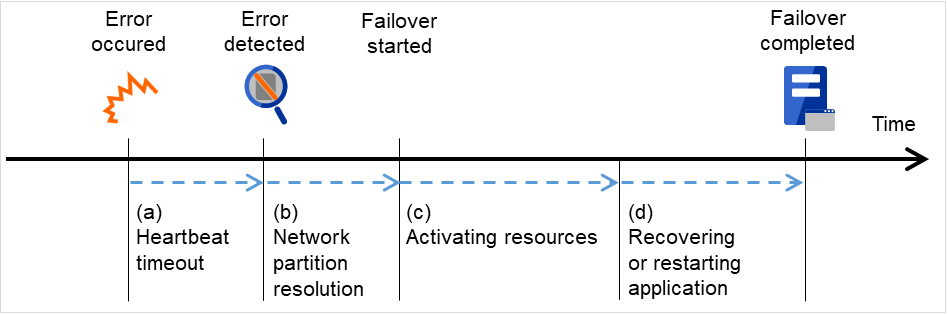

障害発生からフェイルオーバ完了までの時間は数分間必要です。以下にタイムチャートを示します。

図 3.8 フェイルオーバのタイムチャート¶

ハートビートタイムアウト

業務を実行しているサーバの障害発生後、待機系がその障害を検出するまでの時間です。

ネットワークパーティション解決

相手サーバからのハートビートの途絶 (ハートビートタイムアウト) が、ネットワークパーティション状態によるものか、実際に相手サーバが障害を起こしたのかを確認するための時間です。

通常はほぼ瞬時に確認が完了します。

各種リソース活性化

業務で必要なリソースを活性化するための時間です。

ファイルシステム復旧、ディスク内のデータ引継ぎ、IPアドレスの引継ぎ等を行います。

アプリケーション復旧処理・再起動

業務で使用するアプリケーションの起動に要する時間です。データベースのロールバック/ロールフォワードなどのデータ復旧処理の時間も含まれます。

ロールバック/ロールフォワード時間などはチェックポイントインターバルの調整である程度予測可能です。詳しくは、各ソフトウェア製品のドキュメントを参照してください。

3.5.1. フェイルオーバリソース¶

CLUSTERPRO がフェイルオーバ対象とできる主なリソースは以下のとおりです。

切替パーティション (ディスクリソース、ミラーディスクリソース、ハイブリッドディスクリソースなど)

業務アプリケーションが引き継ぐべきデータを格納するためのディスクパーティションです。

フローティング IP アドレス (フローティング IP リソース)

フローティング IP アドレスを使用して業務へ接続することで、フェイルオーバによる業務の実行位置 (サーバ) の変化をクライアントは気にする必要がなくなります。

パブリック LAN アダプタへの IP アドレス動的割り当てと ARP パケットの送信により実現しています。ほとんどのネットワーク機器からフローティング IP アドレスによる接続が可能です

スクリプト (EXEC リソース)

CLUSTERPRO では、業務アプリケーションをスクリプトから起動します。

共有ディスクにて引き継がれたファイルはファイルシステムとして正常であっても、データとして不完全な状態にある場合があります。スクリプトにはアプリケーションの起動のほか、フェイルオーバ時の業務固有の復旧処理も記述します。

注釈

クラスタシステムでは、アプリケーションを健全なノードで起動しなおすことでフェイルオーバを実行します。このため、アプリケーションのメモリ上に格納されている実行状態をフェイルオーバすることはできません。

3.5.2. フェイルオーバ型クラスタのシステム構成¶

フェイルオーバ型クラスタは、ディスクアレイ装置をクラスタサーバ間で共有します。サーバ障害時には待機系サーバが共有ディスク上のデータを使用し業務を引き継ぎます。

図 3.9 フェイルオーバ型クラスタのシステム構成¶

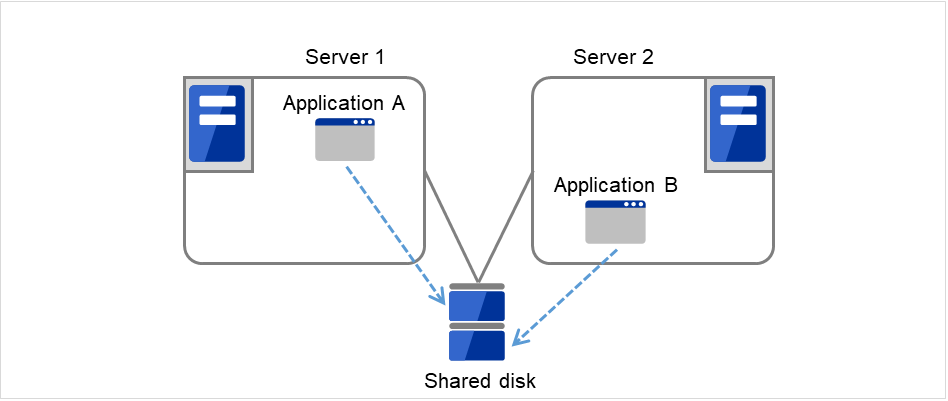

フェイルオーバ型クラスタでは、運用形態により、次のように分類できます。

片方向スタンバイクラスタ

同一アプリケーション双方向スタンバイクラスタ

異種アプリケーション双方向スタンバイクラスタ

N + N 構成

3.5.4. ミラーディスク型のハードウェア構成¶

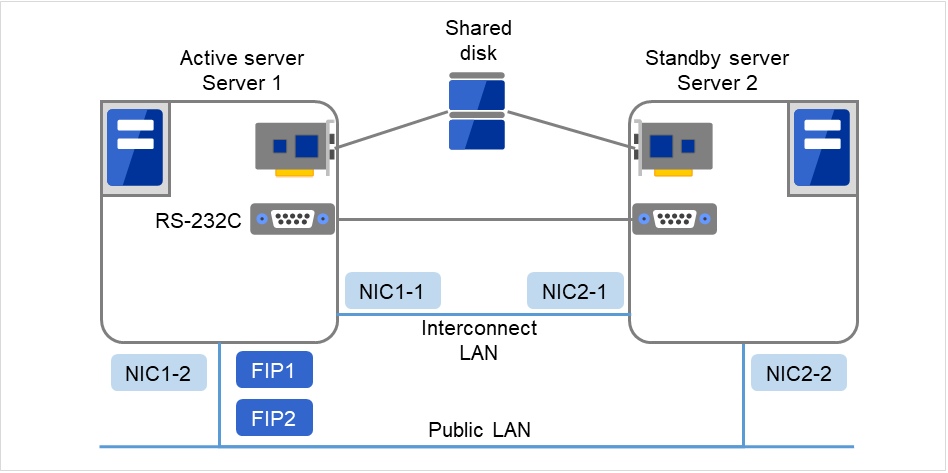

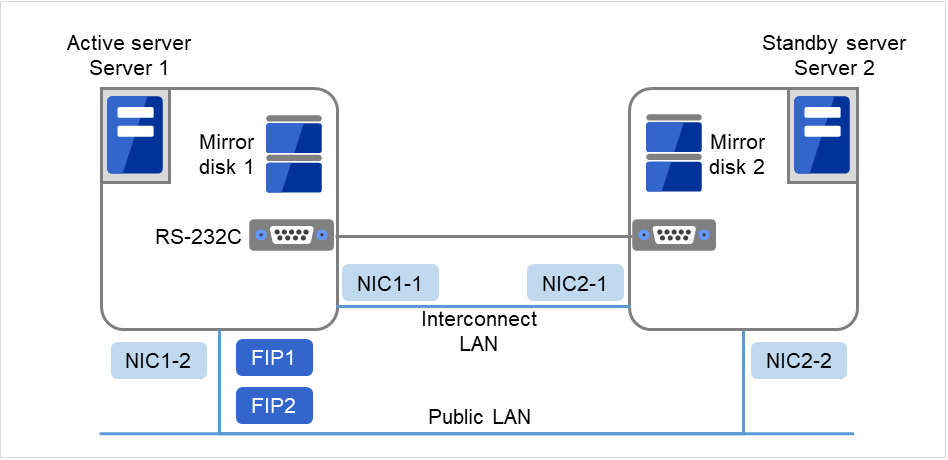

データミラー構成の CLUSTERPRO は、下図のような構成になります。

共有ディスク構成と比べ、ミラーディスクデータコピー用のネットワークが必要となりますが、通常、CLUSTERPRO の内部通信用 NIC と兼用します。

また、ミラーディスクは接続インターフェイス (IDE or SCSI) には依存しません。

ミラーディスク使用時のクラスタ環境のサンプル (OS がインストールされているディスクにクラスタパーティション、データパーティションを確保する場合)

以下の構成では、OSがインストールされているディスクの空きパーティションを、クラスタパーティション、データパーティションとして使用しています。

図 3.19 クラスタ構成例(1)(ミラーディスク型)¶

FIP1

10.0.0.11 (Cluster WebUIクライアントからのアクセス先)

FIP2

10.0.0.12 (業務クライアントからのアクセス先)

NIC1-1

192.168.0.1

NIC1-2

10.0.0.1

NIC2-1

192.168.0.2

NIC2-2

10.0.0.2

RS-232C デバイス

/dev/ttyS0

OSの/bootデバイス

/dev/sda1

OSのswapデバイス

/dev/sda2

OSの/(root)デバイス

/dev/sda3

クラスタパーティション用デバイス

/dev/sda5

データパーティション用デバイス

/dev/sda6

マウントポイント

/mnt/sda6

ファイルシステム

ext3

ミラーディスク使用時のクラスタ環境のサンプル (クラスタパーティション、データパーティション用のディスクを用意する場合)

以下の構成では、クラスタパーティション、データパーティション用にディスクを用意し、接続しています。

図 3.20 クラスタ構成例(2)(ミラーディスク型)¶

FIP1

10.0.0.11 (Cluster WebUIクライアントからのアクセス先)

FIP2

10.0.0.12 (業務クライアントからのアクセス先)

NIC1-1

192.168.0.1

NIC1-2

10.0.0.1

NIC2-1

192.168.0.2

NIC2-2

10.0.0.2

RS-232C デバイス

/dev/ttyS0

OSの/bootデバイス

/dev/sda1

OSのswapデバイス

/dev/sda2

OSの/(root)デバイス

/dev/sda3

クラスタパーティション用デバイス

/dev/sdb1

ミラーリソースディスクデバイス

/dev/sdb2

マウントポイント

/mnt/sdb2

ファイルシステム

ext3

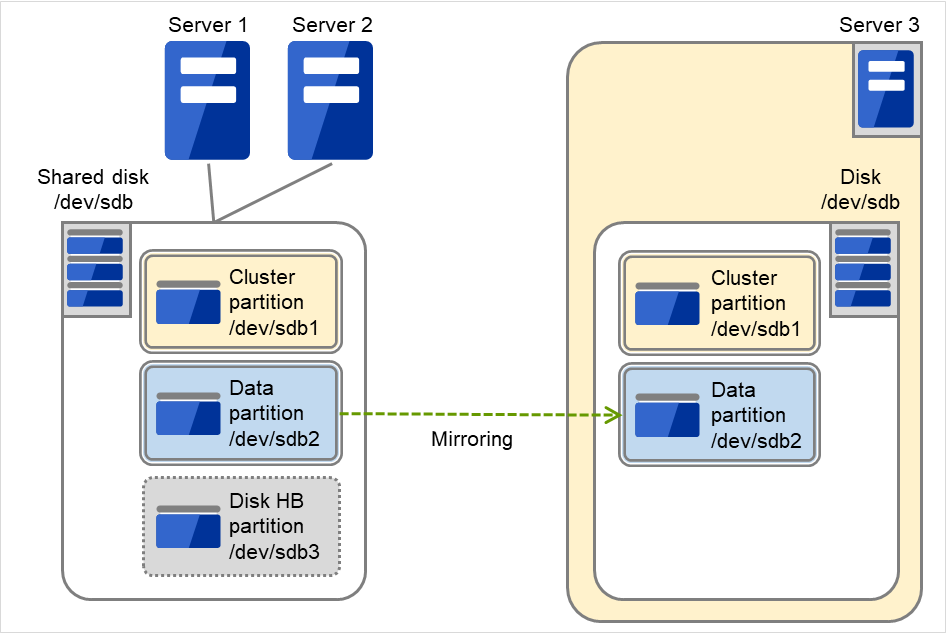

3.5.5. ハイブリッドディスク型のハードウェア構成¶

ハイブリッド構成の CLUSTERPRO は、下図のような構成になります。

共有ディスク構成と比べ、データコピー用のネットワークが必要となりますが、通常、CLUSTERPRO の内部通信用 NIC と兼用します。

また、ディスクは接続インターフェイス (IDE or SCSI) には依存しません。

ハイブリッドディスク使用時のクラスタ環境のサンプル (2 台のサーバで共有ディスクを使用し、3 台目のサーバの通常のディスクへミラーリングする場合)

図 3.21 クラスタ構成例(ハイブリッドディスク型)¶

FIP1

10.0.0.11 (Cluster WebUIクライアントからのアクセス先)

FIP2

10.0.0.12 (業務クライアントからのアクセス先)

NIC1-1

192.168.0.1

NIC1-2

10.0.0.1

NIC2-1

192.168.0.2

NIC2-2

10.0.0.2

NIC3-1

192.168.0.3

NIC3-2

10.0.0.3

共有ディスク

ハイブリッドデバイス

/dev/NMP1

マウントポイント

/mnt/hd1

ファイルシステム

ext3

クラスタパーティション用デバイス

/dev/sdb1

ハイブリッドリソースディスクデバイス

/dev/sdb2

DISKハートビートデバイス名

/dev/sdb3

Rawデバイス名

/dev/raw/raw1

ハイブリッドリソース用ディスク

ハイブリッドデバイス

/dev/NMP1

マウントポイント

/mnt/hd1

ファイルシステム

ext3

クラスタパーティション用デバイス

/dev/sdb1

ハイブリッドリソースディスクデバイス

/dev/sdb2

3.5.6. クラスタオブジェクトとは?¶

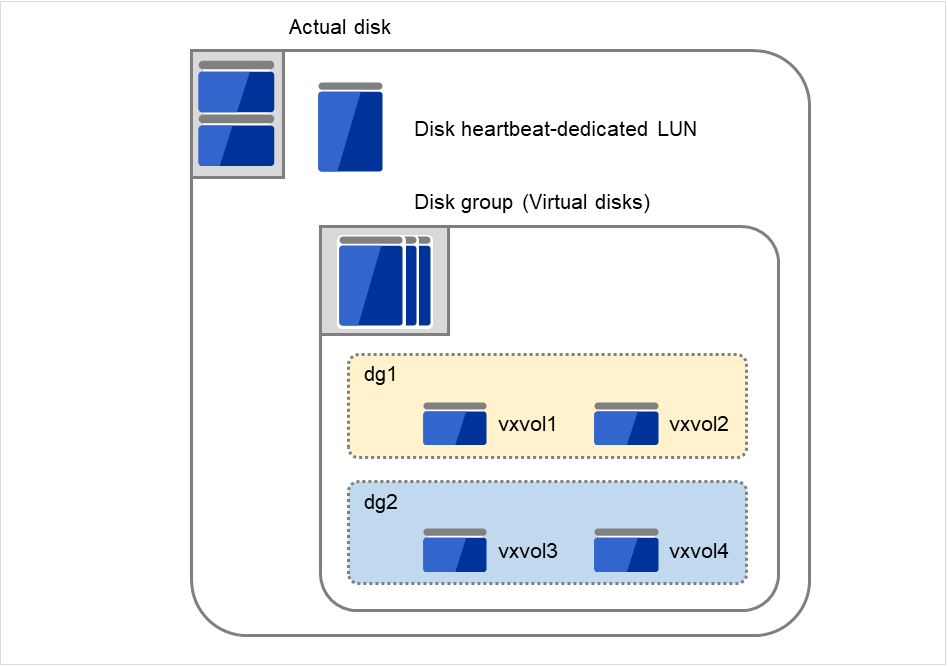

CLUSTERPRO では各種リソースを下のような構成で管理しています。

- クラスタオブジェクトクラスタの構成単位となります。

- サーバオブジェクト実体サーバを示すオブジェクトで、クラスタオブジェクトに属します。

- サーバグループオブジェクトサーバを束ねるオブジェクトで、クラスタオブジェクトに属します。

- ハートビートリソースオブジェクト実体サーバの NW 部分を示すオブジェクトで、サーバオブジェクトに属します。

- ネットワークパーティション解決リソースオブジェクトネットワークパーティション解決機構を示すオブジェクトで、サーバオブジェクトに属します。

- グループオブジェクト仮想サーバを示すオブジェクトで、クラスタオブジェクトに属します。

- グループリソースオブジェクト仮想サーバの持つリソース (NW、ディスク) を示すオブジェクトでグループオブジェクトに属します。

- モニタリソースオブジェクト監視機構を示すオブジェクトで、クラスタオブジェクトに属します。

3.6. リソースとは?¶

CLUSTERPRO では、監視する側とされる側の対象をすべてリソースと呼び、分類して管理します。このことにより、より明確に監視/被監視の対象を区別できるほか、クラスタ構築や障害検出時の対応が容易になります。リソースはハートビートリソース、ネットワークパーティション解決リソース、グループリソース、モニタリソースの 4 つに分類されます。以下にその概略を示します。

3.6.1. ハートビートリソース¶

サーバ間で、お互いの生存を確認するためのリソースです。

以下に現在サポートされているハートビートリソースを示します。

- LAN ハートビートリソースEthernet を利用した通信を示します。

- カーネルモード LAN ハートビートリソースEthernet を利用した通信を示します。

- COM ハートビートリソースRS232C (COM) を利用した通信を示します。

- ディスクハートビートリソース共有ディスク上の特定パーティション (ディスクハートビート用パーティション) を利用した通信を示します。共有ディスク構成の場合のみ利用可能です。

- BMC ハートビートリソースBMC 経由で Ethernet を利用した通信を示します。BMC のハードウェアおよびファームウェアが対応している場合のみ利用可能です。

- Witness ハートビートリソースWitness サーバサービスが動作している外部サーバから取得した各サーバとの通信状態を示します。

3.6.2. ネットワークパーティション解決リソース¶

ネットワークパーティション状態を解決するためのリソースを示します。

- PING ネットワークパーティション解決リソースPING 方式によるネットワークパーティション解決リソースです。

- HTTP ネットワークパーティション解決リソースHTTP 方式によるネットワークパーティション解決リソースです。

3.6.3. グループリソース¶

フェイルオーバを行う際の単位となる、フェイルオーバグループを構成するリソースです。

以下に現在サポートされているグループリソースを示します。

- フローティング IP リソース (fip)仮想的な IP アドレスを提供します。クライアントからは一般の IP アドレスと同様にアクセス可能です。

- EXEC リソース (exec)業務 (DB、httpd、etc..) を起動/停止するための仕組みを提供します。

- ディスクリソース (disk)共有ディスク上の指定パーティションを提供します。 (共有ディスク) 構成の場合のみ利用可能です。

- ミラーディスクリソース (md)ミラーディスク上の指定パーティションを提供します。 (ミラーディスク) 構成の場合のみ利用可能です。

- ハイブリッドディスクリソース (hd)共有ディスク、またはディスク上の指定パーティションを提供します。(ハイブリッド) 構成の場合のみ利用可能です。

- ボリュームマネージャリソース (volmgr)複数のストレージやディスクを一つの論理的なディスクとして扱います。

- NAS リソース (nas)NAS サーバ上の共有リソースへ接続します。(クラスタサーバが NAS のサーバ側として振る舞うリソースではありません。)

- 仮想 IP リソース (vip)仮想的な IP アドレスを提供します。クライアントからは一般の IP アドレスと同様にアクセス可能です。ネットワークアドレスの異なるセグメント間で遠隔クラスタを構成する場合に使用します。

- 仮想マシンリソース (vm)仮想マシンの起動、停止、マイグレーションを行います。

- ダイナミック DNS リソース (ddns)Dynamic DNS サーバに仮想ホスト名と活性サーバの IP アドレスを登録します。

- AWS Elastic IPリソース (awseip)AWS 上で CLUSTERPRO を利用する場合、Elastic IP(以下、EIP)を付与する仕組みを提供します。

- AWS 仮想IPリソース (awsvip)AWS 上で CLUSTERPRO を利用する場合、仮想IP(以下、VIP)を付与する仕組みを提供します。

- AWS DNS リソース (awsdns)AWS 上で CLUSTERPRO を利用する場合、Amazon Route 53 に仮想ホスト名と活性サーバの IP アドレスを登録します。

- Azure プローブポートリソース (azurepp)Microsoft Azure 上で CLUSTERPRO を利用する場合、業務が稼働するノードで特定のポートを開放する仕組みを提供します。

- Azure DNS リソース (azuredns)Microsoft Azure 上で CLUSTERPRO を利用する場合、Azure DNS に仮想ホスト名と活性サーバの IP アドレスを登録します。

- Google Cloud 仮想 IP リソース (gcvip)Google Cloud Platform 上で CLUSTERPRO を利用する場合、業務が稼働するノードで特定のポートを開放する仕組みを提供します。

- Google Cloud DNS リソース (gcdns)Google Cloud Platform 上で CLUSTERPRO を利用する場合、Cloud DNS に仮想ホスト名と活性サーバの IP アドレスを登録します。

- Oracle Cloud 仮想 IP リソース (ocvip)Oracle Cloud Infrastructure 上で CLUSTERPRO を利用する場合、業務が稼働するノードで特定のポートを開放する仕組みを提供します。

3.6.4. モニタリソース¶

クラスタシステム内で、監視を行う主体であるリソースです。

以下に現在サポートされているモニタリソースを示します。

- フローティング IP モニタリソース (fipw)フローティング IP リソースで起動した IP アドレスの監視機構を提供します。

- IP モニタリソース (ipw)外部の IP アドレスの監視機構を提供します。

- ディスクモニタリソース (diskw)ディスクの監視機構を提供します。共有ディスクの監視にも利用されます。

- ミラーディスクモニタリソース (mdw)ミラーディスクの監視機構を提供します。

- ミラーディスクコネクトモニタリソース (mdnw)ミラーディスクコネクトの監視機構を提供します。

- ハイブリッドディスクモニタリソース (hdw)ハイブリッドディスクの監視機構を提供します。

- ハイブリッドディスクコネクトモニタリソース (hdnw)ハイブリッドディスクコネクトの監視機構を提供します。

- PID モニタリソース (pidw)EXEC リソースで起動したプロセスの死活監視機能を提供します。

- ユーザ空間モニタリソース (userw)ユーザ空間のストール監視機構を提供します。

- NIC Link Up/Down モニタリソース (miiw)LAN ケーブルのリンクステータスの監視機構を提供します。

- ボリュームマネージャモニタリソース (volmgrw)複数のストレージやディスクの監視機構を提供します。

- マルチターゲットモニタリソース (mtw)複数のモニタリソースを束ねたステータスを提供します。

- 仮想 IP モニタリソース (vipw)仮想 IP リソースの RIP パケットを送出する機構を提供します。

- ARP モニタリソース (arpw)フローティング IP リソースまたは仮想 IP リソースの ARP パケットを送出する機構を提供します。

- カスタムモニタリソース (genw)監視処理を行うコマンドやスクリプトがある場合に、その動作結果によりシステムを監視する機構を提供します。

- 仮想マシンモニタリソース (vmw)仮想マシンの生存確認を行います。

- 外部連携モニタリソース (mrw)"異常発生通知受信時に実行する異常時動作の設定" と "異常発生通知のCluster WebUI 表示" を実現するためのモニタリソースです。

- ダイナミック DNS モニタリソース (ddnsw)定期的に Dynamic DNS サーバに仮想ホスト名と活性サーバの IP アドレスを登録します。

- プロセス名モニタリソース (psw)プロセス名を指定することで、任意のプロセスの死活監視機能を提供します。

- BMC モニタリソース (bmcw)搭載されているBMCの死活監視機能を提供します。

- DB2 モニタリソース (db2w)IBM DB2 データベースへの監視機構を提供します。

- ftp モニタリソース (ftpw)FTP サーバへの監視機構を提供します。

- http モニタリソース (httpw)HTTP サーバへの監視機構を提供します。

- imap4 モニタリソース (imap4w)IMAP4 サーバへの監視機構を提供します。

- MySQL モニタリソース (mysqlw)MySQL データベースへの監視機構を提供します。

- nfs モニタリソース (nfsw)nfs ファイルサーバへの監視機構を提供します。

- Oracle モニタリソース (oraclew)Oracle データベースへの監視機構を提供します。

- Oracle Clusterware同期管理モニタリソース (osmw)Oracle Clusterware連携プロセスの監視とメンバシップ情報同期機構を提供します。

- pop3 モニタリソース (pop3w)POP3 サーバへの監視機構を提供します。

- PostgreSQL モニタリソース (psqlw)PostgreSQL データベースへの監視機構を提供します。

- samba モニタリソース (sambaw)samba ファイルサーバへの監視機構を提供します。

- smtp モニタリソース (smtpw)SMTP サーバへの監視機構を提供します。

- Sybase モニタリソース (sybasew)Sybase データベースへの監視機構を提供します。

- Tuxedo モニタリソース (tuxw)Tuxedo アプリケーションサーバへの監視機構を提供します。

- WebSphere モニタリソース (wasw)WebSphere アプリケーションサーバへの監視機構を提供します。

- WebLogic モニタリソース (wlsw)WebLogic アプリケーションサーバへの監視機構を提供します。

- WebOTX モニタリソース (otxw)WebOTX アプリケーションサーバへの監視機構を提供します。

- JVM モニタリソース (jraw)Java VMへの監視機構を提供します。

- システムモニタリソース (sraw)システム全体のリソースへの監視機構を提供します。

- プロセスリソースモニタリソース (psrw)プロセス個別のリソースへの監視機構を提供します。

- AWS Elastic IP モニタリソース (awseipw)AWS Elastic IP リソースで付与した EIP の監視機構を提供します。

- AWS 仮想IPモニタリソース (awsvipw)AWS 仮想IPリソースで付与した VIP の監視機構を提供します。

- AWS AZ モニタリソース (awsazw)Availability Zone(以下、AZ) の監視機構を提供します。

- AWS DNS モニタリソース (awsdnsw)AWS DNS リソースで付与した仮想ホスト名と IP アドレスの監視機構を提供します。

- Azure プローブポートモニタリソース (azureppw)Azure プローブポートリソースが起動しているノードに対して、プローブポートの監視機構を提供します。

- Azure ロードバランスモニタリソース (azurelbw)Azure プローブポートリソースが起動していないノードに対して、プローブ ポートと同じポート番号が開放されていないかの監視機構を提供します。

- Azure DNS モニタリソース (azurednsw)Azure DNS リソースで付与した仮想ホスト名と IP アドレスの監視機構を提供します。

- Google Cloud 仮想 IP モニタリソース (gcvipw)Google Cloud 仮想 IP リソースが起動しているノードに対して、死活監視のためのポートの監視機構を提供します。

- Google Cloud ロードバランスモニタリソース (gclbw)Google Cloud 仮想 IP リソースが起動していないノードに対して、ヘルスチェック用ポートと同じポート番号が開放されていないかの監視機構を提供します。

- Google Cloud DNS モニタリソース (gcdnsw)Google Cloud DNS リソースで付与した仮想ホスト名と IP アドレスの監視機構を提供します。

- Oracle Cloud 仮想 IP モニタリソース (ocvipw)Oracle Cloud 仮想 IP リソースが起動しているノードに対して、死活監視のためのポートの監視機構を提供します。

- Oracle Cloud ロードバランスモニタリソース (oclbw)Oracle Cloud 仮想 IP リソースが起動していないノードに対して、ヘルスチェック用ポートと同じポート番号が開放されていないかの監視機構を提供します。

3.7. CLUSTERPRO を始めよう!¶

以上で CLUSTERPRO の簡単な説明が終了しました。

以降は、以下の流れに従い、対応するガイドを読み進めながら CLUSTERPRO を使用したクラスタシステムの構築を行ってください。

3.7.2. クラスタシステムの設計¶

『インストール&設定ガイド』の「システム構成を決定する」、「クラスタシステムを設計する」および

『リファレンスガイド 』の「グループリソースの詳細」、「モニタリソースの詳細」、「ハートビートリソースの詳細」、「ネットワークパーティション解決リソースの詳細」、「その他の設定情報」および『ハードウェア連携ガイド』 を参照してください。

3.7.3. クラスタシステムの構築¶

『インストール&設定ガイド』の全編を参照してください。

3.7.4. クラスタシステムの運用開始後の障害対応¶

『メンテナンスガイド』の「保守情報」および『リファレンスガイド』の「トラブルシューティング」、「エラーメッセージ一覧」を参照してください。

4. CLUSTERPRO の動作環境¶

本章では、CLUSTERPRO の動作環境について説明します。

本章で説明する項目は以下の通りです。

4.1. ハードウェア¶

CLUSTERPRO は以下のアーキテクチャのサーバで動作します。

x86_64

IBM POWER (Replicator, Replicator DR、並びに、Database Agent 以外の Agent は未サポート)

IBM POWER LE (Replicator, Replicator DR、並びに、各 Agent は未サポート)

4.1.1. スペック¶

CLUSTERPRO Server で必要なスペックは下記の通りです。

RS-232C ポート 1 つ (3 ノード以上のクラスタを構築する場合は不要)

Ethernet ポート 2 つ以上

共有ディスク

ミラー用ディスク または ミラー用空きパーティション

CD-ROM ドライブ

4.1.2. NX7700x シリーズとの連携に対応したサーバ¶

BMC ハートビートリソースおよび外部連携モニタリソースの NX7700x シリーズ連携機能が利用可能なサーバは下記の通りです。本機能は下記のサーバ以外では利用できません。

サーバ |

備考 |

|---|---|

NX7700x/A2010M |

最新のファームウェアにアップデートしてください。 |

NX7700x/A2010L |

最新のファームウェアにアップデートしてください。 |

NX7700x/A3012M |

最新のファームウェアにアップデートしてください。 |

NX7700x/A3012L |

最新のファームウェアにアップデートしてください。 |

NX7700x/A3010M |

最新のファームウェアにアップデートしてください。 |

4.1.3. Express5800/A1080a,A1040a シリーズとの連携に対応したサーバ¶

BMC ハートビートリソースおよび外部連携モニタリソースの Express5800/A1080a,A1040a シリーズ連携機能が利用可能なサーバは下記の通りです。本機能は下記のサーバ以外では利用できません。

サーバ |

備考 |

|---|---|

Express5800/A1080a-E |

最新のファームウェアにアップデートしてください。 |

Express5800/A1080a-D |

最新のファームウェアにアップデートしてください。 |

Express5800/A1080a-S |

最新のファームウェアにアップデートしてください。 |

Express5800/A1040a |

最新のファームウェアにアップデートしてください。 |

4.2. ソフトウェア¶

4.2.1. CLUSTERPRO Server の動作環境¶

4.2.2. 動作可能なディストリビューションとkernel¶

注釈

CLUSTERPRO XのCD媒体には、新しいkernelに対応したrpmが含まれていない場合があります。運用環境でのkernelバージョンと本章の「 動作可能なディストリビューションとkernel 」を確認していただき、「CLUSTERPRO Version」に記載されているバージョンに適合したUpdateの適用をお願いいたします。

独自kernelモジュール |

説明 |

|---|---|

カーネルモード LANハートビートドライバ |

カーネルモード LAN ハートビートリソースで使用します。 |

Keepaliveドライバ |

ユーザ空間モニタリソースの監視方法として keepalive を選択した場合に使用します。

シャットダウン監視の監視方法として keepalive を選択した場合に使用します。

|

ミラードライバ |

ミラーディスクリソースで使用します。 |

動作確認済みのディストリビューションと kernel バージョンについては、以下のWebサイトを参照してください。

CLUSTERPRO製品Webサイト→ CLUSTERPRO X→ 動作環境→ Linux 動作環境

注釈

CLUSTERPRO が対応する CentOS のkernelバージョンは、Red Hat Enterprise Linux の対応kernelバージョンを確認してください。

4.2.3. 監視オプションの動作確認済アプリケーション情報¶

モニタリソースの監視対象のアプリケーションのバージョンの情報

x86_64

モニタリソース

備考

Oracle モニタ

Oracle Database 12c Release 1 (12.1)

4.0.0-1~

Oracle Database 12c Release 2 (12.2)

4.0.0-1~

Oracle Database 18c (18.3)

4.1.0-1~

Oracle Database 19c (19.3)

4.1.0-1~

DB2 モニタ

DB2 V10.5

4.0.0-1~

DB2 V11.1

4.0.0-1~

DB2 V11.5

4.2.0-1~

PostgreSQL モニタ

PostgreSQL 9.3

4.0.0-1~

PostgreSQL 9.4

4.0.0-1~

PostgreSQL 9.5

4.0.0-1~

PostgreSQL 9.6

4.0.0-1~

PostgreSQL 10

4.0.0-1~

PostgreSQL 11

4.1.0-1~

PostgreSQL 12

4.2.2-1~

PostgreSQL 13

4.3.0-1~

PowerGres on Linux 9.1

4.0.0-1~

PowerGres on Linux 9.4

4.0.0-1~

PowerGres on Linux 9.6

4.0.0-1~

PowerGres on Linux 11

4.1.0-1~

MySQL モニタ

MySQL 5.5

4.0.0-1~

MySQL 5.6

4.0.0-1~

MySQL 5.7

4.0.0-1~

MySQL 8.0

4.1.0-1~

MariaDB 5.5

4.0.0-1~

MariaDB 10.0

4.0.0-1~

MariaDB 10.1

4.0.0-1~

MariaDB 10.2

4.0.0-1~

MariaDB 10.3

4.1.0-1~

MariaDB 10.4

4.2.0-1~

Sybase モニタ

Sybase ASE 15.5

4.0.0-1~

Sybase ASE 15.7

4.0.0-1~

SAP ASE 16.0

4.0.0-1~

SQL Server モニタ

SQL Server 2017

4.0.0-1~

SQL Server 2019

4.2.0-1~

samba モニタ

Samba 3.3

4.0.0-1~

Samba 3.6

4.0.0-1~

Samba 4.0

4.0.0-1~

Samba 4.1

4.0.0-1~

Samba 4.2

4.0.0-1~

Samba 4.4

4.0.0-1~

Samba 4.6

4.0.0-1~

Samba 4.7

4.1.0-1~

Samba 4.8

4.1.0-1~

Samba 4.13

4.3.0-1~

nfs モニタ

nfsd 2 (udp)

4.0.0-1~

nfsd 3 (udp)

4.0.0-1~

nfsd 4 (tcp)

4.0.0-1~

mountd 1(tcp)

4.0.0-1~

mountd 2(tcp)

4.0.0-1~

mountd 3(tcp)

4.0.0-1~

http モニタ

バージョン指定無し

4.0.0-1~

smtp モニタ

バージョン指定無し

4.0.0-1~

pop3 モニタ

バージョン指定無し

4.0.0-1~

imap4 モニタ

バージョン指定無し

4.0.0-1~

ftp モニタ

バージョン指定無し

4.0.0-1~

Tuxedo モニタ

Tuxedo 12c Release 2 (12.1.3)

4.0.0-1~

WebLogic モニタ

WebLogic Server 11g R1

4.0.0-1~

WebLogic Server 11g R2

4.0.0-1~

WebLogic Server 12c R2 (12.2.1)

4.0.0-1~

WebLogic Server 14c (14.1.1)

4.2.0-1~

WebSphere モニタ

WebSphere Application Server 8.5

4.0.0-1~

WebSphere Application Server 8.5.5

4.0.0-1~

WebSphere Application Server 9.0

4.0.0-1~

WebOTX モニタ

WebOTX Application Server V9.1

4.0.0-1~

WebOTX Application Server V9.2

4.0.0-1~

WebOTX Application Server V9.3

4.0.0-1~

WebOTX Application Server V9.4

4.0.0-1~

WebOTX Application Server V10.1

4.0.0-1~

WebOTX Application Server V10.3

4.3.0-1~

JVM モニタ

WebLogic Server 11g R1

4.0.0-1~

WebLogic Server 11g R2

4.0.0-1~

WebLogic Server 12c

4.0.0-1~

WebLogic Server 12c R2 (12.2.1)

4.0.0-1~

WebLogic Server 14c (14.1.1)

4.2.0-1~

WebOTX Application Server V9.1

4.0.0-1~

WebOTX Application Server V9.2

4.0.0-1~

プロセスグループ監視にはWebOTX updateが必要

WebOTX Application Server V9.3

4.0.0-1~

WebOTX Application Server V9.4

4.0.0-1~

WebOTX Application Server V10.1

4.0.0-1~

WebOTX Application Server V10.3

4.3.0-1~

WebOTX Enterprise Service Bus V8.4

4.0.0-1~

WebOTX Enterprise Service Bus V8.5

4.0.0-1~

WebOTX Enterprise Service Bus V10.3

4.3.0-1~

JBoss Enterprise Application Platform 7.0

4.0.0-1~

JBoss Enterprise Application Platform 7.3

4.3.2-1~

Apache Tomcat 8.0

4.0.0-1~

Apache Tomcat 8.5

4.0.0-1~

Apache Tomcat 9.0

4.0.0-1~

WebSAM SVF for PDF 9.0

4.0.0-1~

WebSAM SVF for PDF 9.1

4.0.0-1~

WebSAM SVF for PDF 9.2

4.0.0-1~

WebSAM Report Director Enterprise 9.0

4.0.0-1~

WebSAM Report Director Enterprise 9.1

4.0.0-1~

WebSAM Report Director Enterprise 9.2

4.0.0-1~

WebSAM Universal Connect/X 9.0

4.0.0-1~

WebSAM Universal Connect/X 9.1

4.0.0-1~

WebSAM Universal Connect/X 9.2

4.0.0-1~

システムモニタ

バージョン指定無し

4.0.0-1~

プロセスリソースモニタ

バージョン指定無し

4.1.0-1~

注釈

x86_64環境で監視オプションをご利用される場合、監視対象のアプリケーションもx86_64版のアプリケーションをご利用ください。

IBM POWER

モニタリソース

備考

DB2 モニタ

DB2 V10.5

4.0.0-1~

PostgreSQL モニタ

PostgreSQL 9.3

4.0.0-1~

PostgreSQL 9.4

4.0.0-1~

PostgreSQL 9.5

4.0.0-1~

PostgreSQL 9.6

4.0.0-1~

PostgreSQL 10

4.0.0-1~

PostgreSQL 11

4.1.0-1~

注釈

IBM POWER環境で監視オプションをご利用される場合、監視対象のアプリケーションもIBM POWER版のアプリケーションをご利用ください。

4.2.4. 仮想マシンリソースの動作環境¶

仮想マシンリソースの動作確認を行った仮想化基盤のバージョン情報を下記に提示します。

仮想化基盤 |

バージョン |

CLUSTERPRO

Version

|

備考 |

|---|---|---|---|

vSphere |

5.5 |

4.0.0-1~ |

管理用OSが必要です。 |

6.5 |

4.0.0-1~ |

管理用OSが必要です。 |

|

6.7 |

4.0.0-1~ |

管理用OSが必要です。 |

|

7.0 |

4.0.0-1~ |

管理用OSが必要です。 |

|

XenServer |

6.5 (x86_64) |

4.0.0-1~ |

|

KVM |

Red Hat Enterprise Linux 6.9 (x86_64) |

4.0.0-1~ |

|

Red Hat Enterprise Linux 7.4 (x86_64) |

4.0.0-1~ |

注釈

XenServer ホストで CLUSTERPRO を使用する場合、以下の機能が利用できません。

カーネルモード LAN ハートビートリソース

ミラーディスクリソース/ハイブリッドディスクリソース

ユーザ空間モニタリソース (keepalive/softdog 方式)

シャットダウン監視 (keepalive/softdog 方式)

4.2.5. JVM モニタの動作環境¶

JVMモニタを使用する場合には、Java 実行環境が必要です。また、JBoss Enterprise Application Platformのドメインモードを監視する場合は、Java(TM) SE Development Kitが必要です。

Java(TM) Runtime Environment |

Version 7.0 Update 6 (1.7.0_6) 以降 |

Java(TM) SE Development Kit |

Version 7.0 Update 1 (1.7.0_1) 以降 |

Java(TM) Runtime Environment |

Version 8.0 Update 11 (1.8.0_11) 以降 |

Java(TM) SE Development Kit |

Version 8.0 Update 11 (1.8.0_11) 以降 |

Java(TM) Runtime Environment |

Version 9.0 (9.0.1) 以降 |

Java(TM) SE Development Kit |

Version 9.0 (9.0.1) 以降 |

Java(TM) SE Development Kit |

Version 11.0 (11.0.5) 以降 |

Open JDK |

Version 7.0 Update 45 (1.7.0_45) 以降

Version 8.0 (1.8.0) 以降

Version 9.0 (9.0.1) 以降

|

JVMモニタ ロードバランサ連携機能の動作確認を行ったロードバランサを下記に提示します。

x86_64

ロードバランサ

備考

Express5800/LB400h以降

4.0.0-1~

InterSec/LB400i 以降

4.0.0-1~

BIG-IP v11

4.0.0-1~

CoyotePoint Equalizer

4.0.0-1~

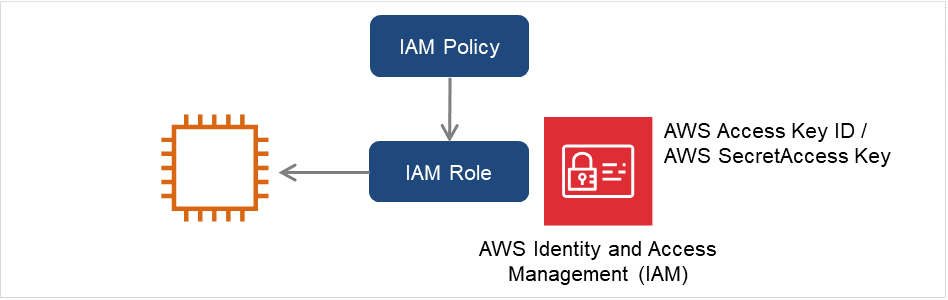

4.2.6. AWS Elastic IP リソース、AWS 仮想 IP リソース、AWS Elastic IP モニタリソース、AWS 仮想 IP モニタリソース、AWS AZ モニタリソースの動作環境¶

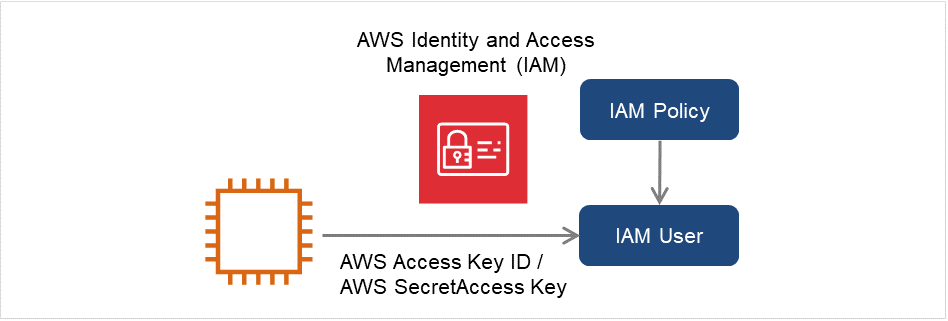

AWS Elastic IPリソース、AWS 仮想IPリソース、AWS Elastic IPモニタリソース、AWS 仮想IPモニタリソース、AWS AZモニタリソースを使用する場合には、以下のソフトウェアが必要です。

ソフトウェア |

Version |

備考 |

|---|---|---|

AWS CLI |

1.6.0~

2.0.0~

|

|

Python |

2.6.5~

2.7.5~

3.5.2~

3.6.8~

3.8.1~

3.8.3~

|

AWS CLI 付属の Python は不可 |

x86_64

ディストリビューション

備考

Red Hat Enterprise Linux 6.8

4.0.0-1~

Red Hat Enterprise Linux 6.9

4.0.0-1~

Red Hat Enterprise Linux 6.10

4.1.0-1~

Red Hat Enterprise Linux 7.3

4.0.0-1~

Red Hat Enterprise Linux 7.4

4.0.0-1~

Red Hat Enterprise Linux 7.5

4.1.0-1~

Red Hat Enterprise Linux 7.6

4.1.0-1~

Red Hat Enterprise Linux 7.7

4.2.0-1~

Red Hat Enterprise Linux 7.8

4.3.0-1~

Red Hat Enterprise Linux 8.2

4.3.0-1~

Cent OS 6.8

4.0.0-1~

Cent OS 6.9

4.0.0-1~

Cent OS 6.10

4.2.0-1~

Cent OS 7.3

4.0.0-1~

Cent OS 7.4

4.0.0-1~

Cent OS 7.5

4.1.0-1~

Cent OS 7.6

4.2.0-1~

SUSE Linux Enterprise Server 11 SP3

4.0.0-1~

SUSE Linux Enterprise Server 11 SP4

4.0.0-1~

SUSE Linux Enterprise Server 12 SP1

4.0.0-1~

SUSE Linux Enterprise Server 12 SP2

4.1.0-1~

SUSE Linux Enterprise Server 12 SP4

4.2.0-1~

SUSE Linux Enterprise Server 15 SP1

4.2.0-1~

Oracle Linux 6.6

4.0.0-1~

Oracle Linux 7.3

4.0.0-1~

Oracle Linux 7.6

4.2.0-1~

Ubuntu 14.04.LTS

4.0.0-1~

Ubuntu 16.04.3 LTS

4.0.0-1~

Ubuntu 18.04.3 LTS

4.2.0-1~

Amazon Linux 2

4.1.0-1~

4.2.7. AWS DNS リソース、AWS DNS モニタリソースの動作環境¶

AWS DNS リソース、AWS DNS モニタリソースを使用する場合には、以下のソフトウェアが必要です。

ソフトウェア |

Version |

備考 |

|---|---|---|

AWS CLI |

1.11.0~

2.0.0~

|

|

Python (Red Hat Enterprise Linux 6, Cent OS 6, SUSE Linux Enterprise Server 11, Oracle Linux 6 の場合) |

2.6.6~

3.6.5~

3.8.1~

|

AWS CLI 付属の Python は不可 |

Python (Red Hat Enterprise Linux 6, Cent OS 6, SUSE Linux Enterprise Server 11, Oracle Linux 6 以外の場合) |

2.7.5~

3.5.2~

3.6.8~

3.8.1~

3.8.3~

|

AWS CLI 付属の Python は不可 |

x86_64

ディストリビューション

備考

Red Hat Enterprise Linux 6.8

4.0.0-1~

Red Hat Enterprise Linux 6.9

4.0.0-1~

Red Hat Enterprise Linux 6.10

4.1.0-1~

Red Hat Enterprise Linux 7.3

4.0.0-1~

Red Hat Enterprise Linux 7.4

4.0.0-1~

Red Hat Enterprise Linux 7.5

4.1.0-1~

Red Hat Enterprise Linux 7.6

4.1.0-1~

Red Hat Enterprise Linux 7.7

4.2.0-1~

Red Hat Enterprise Linux 7.8

4.3.0-1~

Red Hat Enterprise Linux 8.2

4.3.0-1~

Cent OS 6.8

4.0.0-1~

Cent OS 6.9

4.0.0-1~

Cent OS 6.10

4.2.0-1~

Cent OS 7.3

4.0.0-1~

Cent OS 7.4

4.0.0-1~

Cent OS 7.5

4.1.0-1~

Cent OS 7.6

4.2.0-1~

SUSE Linux Enterprise Server 11 SP3

4.0.0-1~

SUSE Linux Enterprise Server 11 SP4

4.0.0-1~

SUSE Linux Enterprise Server 12 SP1

4.0.0-1~

SUSE Linux Enterprise Server 12 SP2

4.1.0-1~

SUSE Linux Enterprise Server 12 SP4

4.2.0-1~

SUSE Linux Enterprise Server 15 SP1

4.2.0-1~

Oracle Linux 6.6

4.0.0-1~

Oracle Linux 7.3

4.0.0-1~

Oracle Linux 7.6

4.2.0-1~

Ubuntu 14.04.LTS

4.0.0-1~

Ubuntu 16.04.3 LTS

4.0.0-1~

Ubuntu 18.04.3 LTS

4.2.0-1~

Amazon Linux 2

4.1.0-1~

4.2.8. Azure プローブポートリソース、Azure プローブポートモニタリソース、Azure ロードバランスモニタリソースの動作環境¶

x86_64

ディストリビューション

備考

Red Hat Enterprise Linux 6.8

4.0.0-1~

Red Hat Enterprise Linux 6.9

4.0.0-1~

Red Hat Enterprise Linux 6.10

4.1.0-1~

Red Hat Enterprise Linux 7.3

4.0.0-1~

Red Hat Enterprise Linux 7.4

4.0.0-1~

Red Hat Enterprise Linux 7.5

4.1.0-1~

Red Hat Enterprise Linux 7.6

4.1.0-1~

Red Hat Enterprise Linux 7.7

4.2.0-1~

Red Hat Enterprise Linux 7.8

4.3.0-1~

Red Hat Enterprise Linux 8.2

4.3.0-1~

CentOS 6.8

4.0.0-1~

CentOS 6.9

4.0.0-1~

CentOS 6.10

4.1.0-1~

CentOS 7.3

4.0.0-1~

CentOS 7.4

4.0.0-1~

CentOS 7.5

4.1.0-1~

CentOS 7.6

4.1.0-1~

Asianux Server 4 SP6

4.0.0-1~

Asianux Server 4 SP7

4.0.0-1~

Asianux Server 7 SP1

4.0.0-1~

Asianux Server 7 SP2

4.0.0-1~

Asianux Server 7 SP3

4.2.0-1~

SUSE Linux Enterprise Server 11 SP3

4.0.0-1~

SUSE Linux Enterprise Server 11 SP4

4.0.0-1~

SUSE Linux Enterprise Server 12 SP1

4.0.0-1~

SUSE Linux Enterprise Server 12 SP2

4.1.0-1~

SUSE Linux Enterprise Server 12 SP4

4.2.0-1~

SUSE Linux Enterprise Server 15 SP1

4.2.0-1~

Oracle Linux 6.6

4.0.0-1~

Oracle Linux 7.3

4.0.0-1~

Oracle Linux 7.5

4.1.0-1~

Oracle Linux 7.7

4.2.0-1~

Ubuntu 14.04.LTS

4.0.0-1~

Ubuntu 16.04.3 LTS

4.0.0-1~

Ubuntu 18.04.3 LTS

4.2.0-1~

Azure プローブポートリソースの動作確認を行った Microsoft Azure 上のデプロイモデルを下記に提示します。ロードバランサーの追加方法は Microsoft のドキュメント(https://azure.microsoft.com/ja-jp/documentation/articles/load-balancer-arm/)を参照してください。

x86_64

デプロイモデル

備考

リソースマネージャー

4.0.0-1~

ロードバランサーの追加が必要

4.2.9. Azure DNS リソース、Azure DNS モニタリソースの動作環境¶

Azure DNS リソース、Azure DNS モニタリソースを使用する場合には、以下のソフトウェアが必要です。

ソフトウェア |

Version |

備考 |

|---|---|---|

Azure CLI (Red Hat Enterprise Linux 6, Cent OS 6, Asianux Server 4, SUSE Linux Enterprise Server 11, Oracle Linux 6 の場合) |

1.0~ |

Python は不要 |

Azure CLI (Red Hat Enterprise Linux 6, Cent OS 6, Asianux Server 4, SUSE Linux Enterprise Server 11, Oracle Linux 6 以外の場合) |

2.0~ |

x86_64

ディストリビューション

備考

Red Hat Enterprise Linux 6.8

4.0.0-1~

Red Hat Enterprise Linux 6.9

4.0.0-1~

Red Hat Enterprise Linux 6.10

4.1.0-1~

Red Hat Enterprise Linux 7.3

4.0.0-1~

Red Hat Enterprise Linux 7.4

4.0.0-1~

Red Hat Enterprise Linux 7.5

4.1.0-1~

Red Hat Enterprise Linux 7.6

4.1.0-1~

Red Hat Enterprise Linux 7.7

4.2.0-1~

Red Hat Enterprise Linux 7.8

4.3.0-1~

Red Hat Enterprise Linux 8.2

4.3.0-1~

CentOS 6.8

4.0.0-1~

CentOS 6.9

4.0.0-1~

CentOS 6.10

4.1.0-1~

CentOS 7.3

4.0.0-1~

CentOS 7.4

4.0.0-1~

CentOS 7.5

4.1.0-1~

CentOS 7.6

4.1.0-1~

Asianux Server 4 SP6

4.0.0-1~

Asianux Server 4 SP7

4.0.0-1~

Asianux Server 7 SP1

4.0.0-1~

Asianux Server 7 SP2

4.0.0-1~

Asianux Server 7 SP3

4.2.0-1~

SUSE Linux Enterprise Server 11 SP3

4.0.0-1~

SUSE Linux Enterprise Server 11 SP4

4.0.0-1~

SUSE Linux Enterprise Server 12 SP1

4.0.0-1~

SUSE Linux Enterprise Server 12 SP2

4.1.0-1~

SUSE Linux Enterprise Server 12 SP4

4.2.0-1~

SUSE Linux Enterprise Server 15 SP1

4.2.0-1~

Oracle Linux 6.6

4.0.0-1~

Oracle Linux 7.3

4.0.0-1~

Oracle Linux 7.5

4.1.0-1~

Oracle Linux 7.7

4.2.0-1~

Ubuntu 14.04.LTS

4.0.0-1~

Ubuntu 16.04.3 LTS

4.0.0-1~

Ubuntu 18.04.3 LTS

4.2.0-1~

x86_64

デプロイモデル

備考

リソースマネージャー

4.0.0-1~

Azure DNS の追加が必要

4.2.10. Google Cloud 仮想 IP リソース、Google Cloud 仮想 IP モニタリソース、Google Cloud ロードバランスモニタリソースの動作環境¶

x86_64

ディストリビューション

備考

Red Hat Enterprise Linux 6.10

4.2.0-1~

Red Hat Enterprise Linux 7.7

4.2.0-1~

SUSE Linux Enterprise Server 15 SP1

4.2.0-1~

Ubuntu 16.04.3 LTS

4.2.0-1~

Ubuntu 18.04.3 LTS

4.2.0-1~

4.2.11. Google Cloud DNS リソース、Google Cloud DNS モニタリソースの動作環境¶

Google Cloud DNS リソース、Google Cloud DNS モニタリソースを使用する場合には、以下のソフトウェアが必要です。

ソフトウェア

Version

備考

Google Cloud SDK

295.0.0~

x86_64

ディストリビューション

備考

Red Hat Enterprise Linux 8.2

4.3.0-1~

4.2.12. Oracle Cloud 仮想 IP リソース、Oracle Cloud 仮想 IP モニタリソース、Oracle Cloud ロードバランスモニタリソースの動作環境¶

x86_64

ディストリビューション

備考

Oracle Linux 6.10

4.2.0-1~

Oracle Linux 7.7

4.2.0-1~

Ubuntu 16.04.3 LTS

4.2.0-1~

Ubuntu 18.04.3 LTS

4.2.0-1~

4.2.13. 必要メモリ容量とディスクサイズ¶

必要メモリサイズ

(ユーザモード)

|

200MB 2

|

|---|---|

必要メモリサイズ

(kernelモード)

|

同期モードの場合

1MB+(リクエストキュー数×I/Oサイズ)+(2MB+差分ビットマップサイズ)×(ミラーディスクリソース、ハイブリッドディスクリソース数)

非同期モードの場合

1MB +{リクエストキュー数}×{I/Oサイズ}

+[3MB

+({I/Oサイズ}×{非同期キュー数})

+({I/Oサイズ}÷ 4KB × 8バイト + 0.5KB)× ({履歴ファイルサイズ制限値}÷{I/Oサイズ}+{非同期キュー数})+{差分ビットマップサイズ}

]×(ミラーディスクリソース、ハイブリッドディスクリソース数)

カーネルモード LAN ハートビートドライバの場合

8MB

キープアライブドライバの場合

8MB

|

必要ディスクサイズ

(インストール直後)

|

300MB

|

必要ディスクサイズ

(運用時)

|

5.0GB + 1.0GB 3

|

注釈

I/O サイズの目安は、以下の様になります。

Ubuntu16の場合、1MB

Ubuntu14、RHEL7の場合、124KB

RHEL6の場合、4KB

リクエストキュー数、非同期キュー数の設定値については『リファレンスガイド』の「グループリソースの詳細」の「ミラーディスクリソースを理解する」を参照してください。

ディスクハートビートリソースが使用するパーティションに必要なサイズは「共有ディスクについて」を参照してください。

クラスタパーティションに必要なサイズは「ミラー用のディスクについて」、「ハイブリッドディスクリソース用のディスクについて」を参照してください。

4.3. Cluster WebUI の動作環境¶

4.3.1. 動作確認済 OS、ブラウザ¶

現在の対応状況は下記の通りです。

ブラウザ |

言語 |

|---|---|

Internet Explorer 11 |

日本語/英語/中国語 |

Internet Explorer 10 |

日本語/英語/中国語 |

Firefox |

日本語/英語/中国語 |

Google Chrome |

日本語/英語/中国語 |

Microsoft Edge (Chromium) |

日本語/英語/中国語 |

注釈

IPアドレスで接続する場合、事前に該当のIPアドレスを [ローカル イントラネット] の [サイト] に登録する必要があります。

注釈

Internet Explorer 11 にて Cluster WebUI に接続すると、Internet Explorer が停止することがあります。本事象回避のために、Internet Explorer のアップデート (KB4052978 以降) を適用してください。なお、Windows 8.1/Windows Server 2012R2 に KB4052978 以降を適用するためには、事前に KB2919355 の適用が必要となります。詳細は Microsoft より展開されている情報をご確認ください。

注釈

タブレットやスマートフォンなどのモバイルデバイスには対応していません。

4.3.2. 必要メモリ容量/ディスク容量¶

必要メモリ容量 500MB 以上

必要ディスク容量 200MB 以上

4.4. Witness サーバの動作環境¶

4.4.1. Witness サーバサービスの動作確認済み環境¶

以下の環境で動作確認済みです。

OS |

実行環境 |

バージョン |

|---|---|---|

Windows Server 2012 R2 |

Node.js 10.13.0 |

4.1.0 |

Windows Server 2019 |

Node.js 12.10.0 |

4.2.0 |

Red Hat Enterprise Linux 7.4 |

Node.js 8.12.0 |

4.1.0 |

Red Hat Enterprise Linux 8.0 |

Node.js 12.10.0 |

4.2.0 |

4.4.2. 必要メモリ容量とディスクサイズ¶

必要メモリサイズ |

50MB + (ノード数 * 0.5 MB) |

|---|---|

必要ディスクサイズ |

1GB |

5. 最新バージョン情報¶

本章では、CLUSTERPROの最新情報について説明します。新しいリリースで強化された点、改善された点などをご紹介します。

5.1. CLUSTERPRO とマニュアルの対応一覧¶

本書では下記のバージョンの CLUSTERPROを前提に説明してあります。CLUSTERPROのバージョンとマニュアルの版数に注意してください。

CLUSTERPROの

内部バージョン

|

マニュアル |

版数 |

備考 |

|---|---|---|---|

4.3.4-1 |

スタートアップガイド |

第 13 版 |

|

インストール&設定ガイド |

第 5 版 |

||

リファレンスガイド |

第 9 版 |

||

メンテナンスガイド |

第 4 版 |

||

ハードウェア連携ガイド |

第 1 版 |

||

互換機能ガイド |

第 2 版 |

5.2. 機能強化¶

各バージョンにおいて以下の機能強化を実施しています。

項番 |

内部バージョン |

機能強化項目 |

|---|---|---|

1 |

4.0.0-1 |

デザインを刷新した管理GUI (Cluster WebUI) を実装しました。 |

2 |

4.0.0-1 |

WebManager が HTTPS プロトコルに対応しました。 |

3 |

4.0.0-1 |

期限付きライセンスが利用可能になりました。 |

4 |

4.0.0-1 |

ミラーディスクリソース、ハイブリッドディスクリソースの最大数を拡大しました。 |

5 |

4.0.0-1 |

ボリュームマネージャリソース、ボリュームマネージャモニタリソースがZFS ストレージプールに対応しました。 |

6 |

4.0.0-1 |

対応 OS を拡充しました。 |

7 |

4.0.0-1 |

systemd に対応しました。 |

8 |

4.0.0-1 |

Oracle モニタリソースが Oracle Database 12c R2 に対応しました。 |

9 |

4.0.0-1 |

MySQL モニタリソースが MariaDB 10.2 に対応しました。 |

10 |

4.0.0-1 |

PostgreSQL モニタリソースが PowerGres on Linux 9.6 に対応しました。 |

11 |

4.0.0-1 |

SQL Server モニタリソースを追加しました。 |

12 |

4.0.0-1 |

ODBC モニタリソースを追加しました。 |

13 |

4.0.0-1 |

WebOTX モニタリソースが WebOTX V10.1 に対応しました。 |

14 |

4.0.0-1 |

JVM モニタリソースが Apache Tomcat 9.0 に対応しました。 |

15 |

4.0.0-1 |

JVM モニタリソースが WebOTX V10.1 に対応しました。 |

16 |

4.0.0-1 |

JVMモニタリソースで以下の監視が可能になりました。

|

17 |

4.0.0-1 |

AWS DNS リソース、AWS DNS モニタリソースを追加しました。 |

18 |

4.0.0-1 |

Azure DNS リソース、Azure DNS モニタリソースを追加しました。 |

19 |

4.0.0-1 |

モニタリソースにおけるエラー判定およびタイムアウト判定の精度を改善しました。 |

20 |

4.0.0-1 |

グループリソースの活性/非活性の前後で、任意のスクリプトを実行する機能を追加しました。 |

21 |

4.0.0-1 |

両系活性検出時に生存させるサーバグループを選択できるようにしました。 |

22 |

4.0.0-1 |

フェイルオーバ属性に[完全排他]が設定されているグループにて、排他の対象とする組み合わせを設定できるようになりました。 |

23 |

4.0.0-1 |

内部プロセス間通信で消費されるTCPポート量を削減しました。 |

24 |

4.0.0-1 |

ログ収集で収集する項目を強化しました。 |

25 |

4.0.0-1 |

ミラーディスクリソース、ハイブリッドディスクリソースの差分ビットマップサイズを設定できるようになりました。 |

26 |

4.0.1-1 |

新しくリリースされた kernel に対応しました。 |

27 |

4.0.1-1 |

WebManager において、設定不備により HTTPS を使用できない場合に、syslog およびアラートログへメッセージを出力するようにしました。 |

28 |

4.1.0-1 |

新しくリリースされた kernel に対応しました。 |

29 |

4.1.0-1 |

Red Hat Enterprise Linux 7.6 に対応しました。 |

30 |

4.1.0-1 |

SUSE Linux Enterprise Server 12 SP2 に対応しました。 |

31 |

4.1.0-1 |

Amazon Linux 2 に対応しました。 |

32 |

4.1.0-1 |

Oracle Linux 7.5 に対応しました。 |

33 |

4.1.0-1 |

Oracle モニタリソースが Oracle Database 18c に対応しました。 |

34 |

4.1.0-1 |

Oracle モニタリソースが Oracle Database 19c に対応しました。 |

35 |

4.1.0-1 |

PostgreSQL モニタリソースが PostgreSQL11 に対応しました。 |

36 |

4.1.0-1 |

PostgreSQL モニタリソースが PowerGres V11 に対応しました。 |

37 |

4.1.0-1 |

MySQL モニタリソースが MySQL8.0 に対応しました。 |

38 |

4.1.0-1 |

MySQL モニタリソースが MariaDB10.3 に対応しました。 |

39 |

4.1.0-1 |

以下のリソース / モニタリソースが Python3 に対応しました。

|

40 |

4.1.0-1 |

SAP NetWeaver 用 SAP 連携コネクタが以下の OS に対応しました。

|

41 |

4.1.0-1 |

SAP NetWeaver 用 SAP 連携コネクタが以下の SAP NetWeaver に対応しました。

|

42 |

4.1.0-1 |

SAP NetWeaver 用 SAP 連携コネクタ / サンプルスクリプトが以下に対応しました。

|

43 |

4.1.0-1 |

Samba モニタリソースが以下に対応しました。

|

44 |

4.1.0-1 |

Cluster WebUI でクラスタの構築、構成変更が可能になりました。 |

45 |

4.1.0-1 |

ミラーディスクリソース / ハイブリッドディスクリソースが RAW パーティションに対応しました |

46 |

4.1.0-1 |

ミラーの設定項目に 「ミラー復帰 I/O サイズ」 を追加し、ミラー復帰性能をチューニング可能になりました。 |

47 |

4.1.0-1 |

ハイブリッドディスクリソース (非同期モード) のサーバグループ内のフェイルオーバ処理時間を改善しました。 |

48 |

4.1.0-1 |

ハイブリッドディスクリソースのミラー復帰中にサーバグループ内のフェイルオーバが可能になりました。 |

49 |

4.1.0-1 |

ミラー非同期モードの未送信データのバッファリング機構を改善しました。 |

50 |

4.1.0-1 |

DB2 用 DB 静止点コマンドを追加しました。 |

51 |

4.1.0-1 |

PostgreSQL 用 DB 静止点コマンドを追加しました。 |

52 |

4.1.0-1 |

Sybase 用 DB 静止点コマンドを追加しました。 |

53 |

4.1.0-1 |

SQL Server 用 DB 静止点コマンドを追加しました。 |

54 |

4.1.0-1 |

MySQL 用 DB 静止点コマンドが MariaDB に対応しました。 |

55 |

4.1.0-1 |

Witness ハートビートリソースを追加しました。 |

56 |

4.1.0-1 |

HTTP ネットワークパーティション解決リソースを追加しました。 |

57 |

4.1.0-1 |

クラスタ構成の変更時、業務を停止せずに変更を反映可能な設定項目を拡充しました。 |

58 |

4.1.0-1 |

フェイルオーバグループの起動時に、フローティング IP アドレスの重複チェックを行う機能を追加しました。 |

59 |

4.1.0-1 |

遠隔クラスタ構成で、サーバグループ間のハートビートタイムアウトを検出しても、設定された時間だけ自動フェイルオーバを猶予する機能を追加しました。 |

60 |

4.1.0-1 |

EXEC リソースの開始 / 終了スクリプトで使用できる環境変数を拡充しました。 |

61 |

4.1.0-1 |

強制停止スクリプトの実行結果を判定し、フェイルオーバを抑制する機能を追加しました。 |

62 |

4.1.0-1 |

強制停止機能および筐体 ID 連携機能で実行する IPMI コマンドラインを編集できるようにしました。 |

63 |

4.1.0-1 |

プロセスリソースモニタリソースを追加し、システムモニタリソースのプロセスリソース監視機能を集約しました。 |

64 |

4.1.0-1 |

ミラー統計情報に新たな統計値を追加しました。 |

65 |

4.1.0-1 |

システムリソース統計情報採取機能を追加しました。 |

66 |

4.1.0-1 |

フェイルオーバグループ、グループリソース、モニタリソースの稼働状況をクラスタ統計情報として保存する機能を追加しました。 |

67 |

4.1.0-1 |

ログ収集のパターンに、ミラー統計情報とクラスタ統計情報を追加しました。 |

68 |

4.1.0-1 |

カスタムモニタリソースに、非同期スクリプトの監視開始を待ち合わせる機能を追加しました。 |

69 |

4.1.0-1 |

クラスタ停止の実行時、グループリソースの停止前にカスタムモニタリソースの停止完了を待ち合わせる設定を追加しました。 |

70 |

4.1.0-1 |

clpmonctrl コマンドに処理を要求する先のサーバを指定するためのオプションを追加しました。 |

71 |

4.1.0-1 |

WebManager サーバに対する HTTPS 接続において、SSL および TLS 1.0 を無効化しました。 |

72 |

4.1.0-1 |

共有ディスクデバイスが使用可能となるまでクラスタの起動を待ち合わせる機能を追加しました。 |

73 |

4.1.0-1 |

NX7700x シリーズ連携機能の障害検出時の回復動作処理を改善しました。 |

74 |

4.1.0-1 |

シャットダウン監視の既定値を 「常に実行する」 から 「グループ非活性処理に失敗した場合のみ実行する」 に変更しました。 |

75 |

4.1.1-1 |

Asianux Server 7 SP3 に対応しました。 |

76 |

4.1.1-1 |

Cluster WebUI の表示および操作を改善しました。 |

77 |

4.1.2-1 |

新しくリリースされた kernel に対応しました。 |

78 |

4.1.2-1 |

Cluster WebUI および HTTP モニタリソースが OpenSSL 1.1.1 に対応しました。 |

79 |

4.2.0-1 |

クラスタの操作および状態取得が可能なRESTful APIを追加しました。 |

80 |

4.2.0-1 |

Cluster WebUIやコマンドにおけるクラスタ情報の取得処理を改善しました。 |

81 |

4.2.0-1 |

クラスタ構成情報チェック機能を追加しました。 |

82 |

4.2.0-1 |

異常検出時の動作としてOSパニックを実行する際に、待機系サーバへ記録メッセージの内容を強化しました。 |

83 |

4.2.0-1 |

グループの自動起動やグループリソース活性・非活性異常時の復旧動作を無効化する機能を追加しました。 |

84 |

4.2.0-1 |

ライセンス管理コマンドにて、クラスタノード削除時における期限付きライセンスの再構成が可能となりました。 |

85 |

4.2.0-1 |

OSのユーザアカウントにより、Cluster WebUIにログインできるようになりました。 |

86 |

4.2.0-1 |

EXECリソースにおいて、現用系サーバでの開始・終了スクリプトの実行と連動して、待機系サーバでもスクリプトを実行できるようになりました。 |

87 |

4.2.0-1 |

業務を停止せずにクラスタノードの追加・削除が可能となりました。 |

88 |

4.2.0-1 |

グループの停止待ち合わせの設定条件を拡充しました。 |

89 |

4.2.0-1 |

Cluster WebUI でグループ起動停止予測時間を表示する機能を追加しました。 |

90 |

4.2.0-1 |

新しくリリースされた kernel に対応しました。 |

91 |

4.2.0-1 |

Red Hat Enterprise Linux 7.7 に対応しました。 |

92 |

4.2.0-1 |

SUSE LINUX Enterprise Server 15 に対応しました。 |

93 |

4.2.0-1 |

SUSE LINUX Enterprise Server 15 SP1 に対応しました。 |

94 |

4.2.0-1 |

SUSE LINUX Enterprise Server 12 SP4 に対応しました。 |

95 |

4.2.0-1 |

Oracle Linux 7.7 に対応しました。 |

96 |

4.2.0-1 |

Ubuntu 18.04.3 LTS に対応しました。 |

97 |

4.2.0-1 |

以下の機能でProxyサーバを利用できるようになりました。

|

98 |

4.2.0-1 |

Cluster WebUIやclpstatコマンドで、クラスタ停止状態、クラスタサスペンド状態における表示内容を改善しました。 |

99 |

4.2.0-1 |

ログ収集のパターンに、システム統計情報を追加しました。 |

100 |

4.2.0-1 |

グループ起動停止予測時間およびモニタリソースの監視所用時間を表示するコマンドを追加しました。 |

101 |

4.2.0-1 |

システムリソース統計情報の出力先を変更しました。 |

102 |

4.2.0-1 |

システムリソース統計情報の採取情報を拡充しました。 |

103 |

4.2.0-1 |

HTTPモニタリソースが、BASIC認証に対応しました。 |

104 |

4.2.0-1 |

AWS AZ監視リソースのステータスを、アベイラビリティゾーンの状態が information または impaired の場合、異常から警告に変更しました。 |

105 |

4.2.0-1 |

Google Cloud 仮想IPリソース、Google Cloud 仮想IPモニタリソースを追加しました。 |

106 |

4.2.0-1 |

Oracle Cloud 仮想IPリソース、Oracle Cloud 仮想IPモニタリソースを追加しました。 |

107 |

4.2.0-1 |

以下のモニタリソースについて、[AWS CLI コマンド応答取得失敗時動作] の既定値を「回復動作を実行しない(警告を表示する)」から「回復動作を実行しない(警告を表示しない)」に変更しました。

|

108 |

4.2.0-1 |

DB2モニタリソースがDB2 v11.5に対応しました。 |

109 |

4.2.0-1 |

MySQLモニタリソースがMariaDB 10.4に対応しました。 |

110 |

4.2.0-1 |

SQL ServerモニタリソースがSQL Server 2019に対応しました。 |

111 |

4.2.0-1 |

ミラーディスクリソースのデータパーティションサイズを無停止で拡張する機能を追加しました。 |

112 |

4.2.0-1 |

ディスクモニタリソースのタイムアウト発生時におけるアラートログの出力情報を改善しました。 |

113 |

4.2.2-1 |

新しくリリースされた kernel に対応しました。 |

114 |

4.2.2-1 |

Red Hat Enterprise Linux 7.8 に対応しました。 |

115 |

4.2.2-1 |

Red Hat Enterprise Linux 8.1 に対応しました。 |

116 |

4.2.2-1 |

MIRACLE LINUX 8 Asianux Inside に対応しました。 |

117 |

4.2.2-1 |

RESTful APIで取得可能なリソースステータス情報を拡充しました。 |

118 |

4.2.2-1 |

PostgreSQLモニタリソースがPostgreSQL12に対応しました。 |

119 |

4.3.0-1 |

新しくリリースされた kernel に対応しました。 |

120 |

4.3.0-1 |

Red Hat Enterprise Linux 7.9 に対応しました。 |

121 |

4.3.0-1 |

Red Hat Enterprise Linux 8.2 に対応しました。 |

122 |

4.3.0-1 |

Ubuntu 20.04.1 LTS に対応しました。 |

123 |

4.3.0-1 |

SUSE LINUX Enterprise Server 12 SP5 に対応しました。 |

124 |

4.3.0-1 |

SUSE LINUX Enterprise Server 15 SP2 に対応しました。 |

125 |

4.3.0-1 |

RESTful API で、モニタリソースやハートビートに使用するタイムアウトの倍率を操作/参照できるようになりました。 |

126 |

4.3.0-1 |

RESTful API で clprexec コマンド相当の機能を拡充しました。 |

127 |

4.3.0-1 |

RESTful API でユーザグループ単位/IPアドレス単位で権限(操作/参照)の設定が可能となりました。 |

128 |

4.3.0-1 |

Cluster WebUIでリソース追加時に、システム環境に応じたリソースタイプのみ表示するように改善しました。 |

129 |

4.3.0-1 |

Cluster WebUI で AWS に関するリソースの設定を自動取得する機能を追加しました。 |

130 |

4.3.0-1 |

期限付きライセンスの期限が切れた時のクラスタの動作を変更しました。 |

131 |

4.3.0-1 |

ハートビートタイムアウト時間内にサーバが再起動した場合に、syslogおよびアラートログへメッセージを出力するようにしました。 |

132 |

4.3.0-1 |

フェイルオーバグループ起動時に、グループリソースを自動起動しないようにする機能を追加しました。 |

133 |

4.3.0-1 |

両系活性検出時のシャットダウン動作を改善しました。 |

134 |

4.3.0-1 |

clpbwctrl コマンドにクラスタ起動時の NP 解決を無効化する機能を追加しました。 |

135 |

4.3.0-1 |

サーバの最大再起動回数の既定値を 3 回、リセット時間を 60 分に変更しました。 |

136 |

4.3.0-1 |

異常検出時動作でサーバリセット、パニックが行われた場合、ハートビートタイムアウト時間を待たずにフェイルオーバする機能を追加しました。 |

137 |

4.3.0-1 |

clpgrp/clprsc/clpdown/clpstdn/clpcl コマンドで使用する内部通信タイムアウトの既定値を伸ばしました。 |

138 |

4.3.0-1 |

アラートサービスにAmazon SNSへのメッセージ送信機能を追加しました。 |

139 |

4.3.0-1 |

モニタリソースの監視処理時間をメトリクスとしてAmazon CloudWatchに送信できるようになりました。 |

140 |

4.3.0-1 |

fluentd等のログデータ収集ツールに対応しました。 |

141 |

4.3.0-1 |

モニタリソースの監視処理時間をメトリクスとしてStatsDに送信できるようになりました。 |

142 |

4.3.0-1 |

クラスタ構成情報チェック機能のチェック項目を拡充しました。 |

143 |

4.3.0-1 |

イメージバックアップリストアを簡易化するコマンドclpbackup.sh, clprestore.sh を追加しました。 |

144 |

4.3.0-1 |

Google Cloud DNSリソース、Google Cloud DNSモニタリソースを追加しました。 |

145 |

4.3.0-1 |

HTTPネットワークパーティション解決リソースによるネットワークパーティション検出時のアラートメッセージを改善しました。 |

146 |

4.3.0-1 |

Cluster WebUI の操作ログをサーバ側に出力できるようになりました。 |

147 |

4.3.0-1 |

監視タイムアウト検出時にメモリダンプを取得できるようになりました。 |

148 |

4.3.0-1 |

アラートログの詳細(対処など)を Cluster WebUI から確認できるようになりました。 |

149 |

4.3.0-1 |

Witnessサーバで同じクラスタ名を持つ複数のクラスタを管理できるようになりました。 |

150 |

4.3.0-1 |

クラスタ構成情報作成コマンド clpcfset を追加しました。 |

151 |

4.3.0-1 |

Cluster WebUI の設定モードの[グループのプロパティ]からグループリソース一覧が確認できるようになりました。 |

152 |

4.3.0-1 |

Cluster WebUI の設定モードの[モニタ共通のプロパティ]からモニタリソース一覧が確認できるようになりました。 |

153 |

4.3.0-1 |

Cluster WebUI が Microsoft Edge(Chromium版)に対応しました。 |

154 |

4.3.0-1 |

Cluster WebUI でアラートログの詳細フィルタの対象にメッセージを追加しました。 |

155 |

4.3.0-1 |

モニタリソースの遅延警告メッセージを改善しました。 |

156 |

4.3.0-1 |

活性時監視対象のグループ起動処理中に監視異常を検出した際のメッセージを改善しました。 |

157 |

4.3.0-1 |

Cluster WebUIのパスワード等の設定をリセットするコマンド clpcfreset を追加しました。 |

158 |

4.3.0-1 |

Cluster WebUI の[ステータス]画面の操作アイコンのレイアウトを改善しました。 |

159 |

4.3.0-1 |

サーバグループ間のフェイルオーバ時の猶予時間の設定可能な上限値を拡張しました。 |

160 |

4.3.0-1 |

Cluster WebUI の[ダッシュボード]のユーザーカスタマイズ設定をブラウザ再起動時にも維持するようになりました。 |

161 |

4.3.0-1 |

システムモニタリソースを複数登録できるようになりました。 |

162 |

4.3.0-1 |

プロセスリソースモニタリソースを複数登録できるようになりました。 |

163 |

4.3.0-1 |

プロセスリソースモニタリソースで、特定のプロセスのみを監視対象とする機能を追加しました。 |

164 |

4.3.0-1 |

HTTPモニタリソースが、GETリクエストの監視に対応しました。 |

165 |

4.3.0-1 |

Weblogicモニタリソースの監視方式に REST API を追加しました。 |

166 |

4.3.0-1 |

システムリソース情報の収集に必要な zip, unzip パッケージが不足した場合、警告メッセージを出力するようにしました。 |

167 |

4.3.0-1 |

NFSモニタリソースのNFSバージョンの既定値をv4に変更しました。 |

168 |

4.3.0-1 |

WebOTX モニタリソースがWebOTX V10.3 に対応しました。 |

169 |

4.3.0-1 |

JVM モニタリソースがWebOTX V10.3 に対応しました。 |

170 |

4.2.0-1 |

Weblogic モニタリソースがOracle WebLogic Server 14c (14.1.1) に対応しました。 |

171 |

4.2.0-1 |

JVM モニタリソースがOracle WebLogic Server 14c (14.1.1) に対応しました。 |

172 |

4.3.0-1 |

Samba モニタリソースが Samba 4.13 に対応しました。 |

173 |

4.3.0-1 |

JVM モニタリソースが Java11 に対応しました。 |

174 |

4.3.0-1 |

ミラーディスクリソースおよびハイブリッドディスクリソースで使用するミラーデータの通信の暗号化に対応しました。 |

175 |

4.3.0-1 |

ミラーディスクリソースおよびハイブリッドディスクリソースが ext4ファイルシステムの 64bit feature、uninit_bg feature に対応しました。 |

176 |

4.3.0-1 |

ミラーディスクリソースのデータパーティションサイズを無停止で拡張する機能が ext2、ext3、ext4 ファイルシステムに対応しました。 |

177 |

4.3.0-1 |

ハイブリッドディスクリソースのデータパーティションサイズを無停止で拡張する機能を追加しました。 |

178 |

4.3.0-1 |

xfsファイルシステム利用時の初期ミラー構築および完全コピーの所要時間が改善しました。 |

179 |

4.3.0-1 |

ミラー復帰速度を改善しました。 |

180 |

4.3.0-1 |

以下のリソースが AWS CLI v2 に対応しました。

|

181 |

4.3.2-1 |

ミラーディスクリソースの設定値「初期mkfsを行う」の既定値をオフにしました。 |

182 |

4.3.2-1 |

MIRACLE LINUX 8.4 に対応しました。 |

183 |

4.3.2-1 |

Red Hat Enterprise Linux 8.4 に対応しました。 |

5.3. 修正情報¶

各バージョンにおいて以下の修正を実施しています。

項番 |

修正バージョン

/ 発生バージョン

|

修正項目 |

重要度 |

発生条件

発生頻度

|

|---|---|---|---|---|

1 |

4.0.1-1

/ 4.0.0-1

|

同一製品の期限付きライセンスが2つ有効化されることがある。 |

小 |

ライセンス期限切れの際にストックされた未使用のライセンスを自動的に有効化する処理と、ライセンス登録コマンドによる新規ライセンスの登録操作が同時に行われた場合に、稀に発生する。 |

2 |

4.0.1-1

/ 4.0.0-1

|

clpgrpコマンドによるグループの起動が失敗する。 |

小 |

排他ルールが設定された構成で、起動対象のグループ名を指定せずにclpgrpコマンドを実行した場合に発生する。 |

3 |

4.0.1-1

/ 4.0.0-1

|

CPUライセンスとVMノードライセンスが混在する構成で、CPUライセンスの不足を示す警告メッセージが出力される。 |

小 |

CPUライセンスとVMノードライセンスが混在する場合に発生する。 |

4 |

4.0.1-1

/ 4.0.0-1

|

Azure DNS モニタリソースにおいて、Azure 上のDNSサーバーが正常に稼働していても異常となる場合がある。 |

小 |

以下の条件をすべて満たす場合、必ず発生する。

・[名前解決確認をする] がオンの場合

・Azure CLI のバージョンが 2.0.30 ~ 2.0.32 の場合(2.0.29 以下、2.0.33 以上だと発生しない)

|

5 |

4.0.1-1

/ 4.0.0-1

|

Azure DNS モニタリソースにおいて、Azure 上のDNSサーバーの一部が正常に稼働している場合でも異常となる場合がある。 |

小 |

以下の条件をすべて満たす場合、必ず発生する。

・[名前解決確認をする] がオンの場合

・Azure CLI により取得したDNSサーバー一覧で最初に表示されるDNSサーバーが正常に稼働していない場合(2番目以降のDNSサーバーは正常に稼働)

|

6 |

4.0.1-1

/ 4.0.0-1

|

Azure DNS モニタリソースにおいて、Azure 上のDNSサーバー一覧の取得に失敗した場合でも異常とならない。 |

小 |

以下の条件をすべて満たす場合、必ず発生する。

・[名前解決確認をする] がオンの場合

・Azure CLI によるDNSサーバー一覧の取得に失敗した場合

|

7 |

4.0.1-1

/ 4.0.0-1

|

JVM モニタリソース利用時、監視対象Java VM でメモリリークが発生することがある。 |

中 |

以下の条件の場合に発生することがある。

・[監視(固有)]タブ-[調整]プロパティ-[スレッド]タブ-[動作中のスレッド数を監視する]がオンの場合

|

8 |

4.0.1-1

/ 4.0.0-1

|

JVMモニタリソースのJavaプロセスにおいて、メモリリークが発生することがある。 |

中 |

以下の条件をすべて満たす場合、発生することがある。

・[監視(固有)]タブ-[調整]プロパティ内の設定をすべてオフにした場合

・JVM モニタリソースを複数作成した場合

|

9 |

4.0.1-1

/ 4.0.0-1

|

JVM モニタリソースにおいて、以下のパラメータをオフにしてもJVM統計ログ(jramemory.stat)が出力される。

・[監視(固有)]タブ-[調整]プロパティ-[メモリ]タブ-[ヒープ使用量を監視する]

・[監視(固有)]タブ-[調整]プロパティ-[メモリ]タブ-[非ヒープ使用量を監視する]

|

小 |

以下の条件をすべて満たす場合、必ず発生する。

・[監視(固有)]タブ-[JVM 種別]が[Oracle Java(usage monitoring)]の場合

・[監視(固有)]タブ-[調整]プロパティ-[メモリ]タブ-[ヒープ使用量を監視する]がオフの場合

・[監視(固有)]タブ-[調整]プロパティ-[メモリ]タブ-[非ヒープ使用量を監視する]がオフの場合

|

10 |

4.1.0-1

/ 4.0.0-1

|

SAP NetWeaver 用サンプルスクリプトを利用したカスタムモニタリソースの障害検出時において、SAP サービスの停止処理中に SAP サービスの開始処理が行われる。 |

小 |

SAP サービスの停止処理に時間が掛かる場合に発生する。 |

11 |

4.1.0-1

/ 4.0.0-1

|

AWS で使用するタグの内容にASCII 文字以外が含まれる場合、AWS 仮想 IP リソースの活性に失敗する。 |

小 |

AWS で使用するタグの内容に ASCII 文字以外が含まれる場合、必ず発生する。 |

12 |

4.1.0-1

/ 4.0.0-1

|

CLUSTERPRO の言語設定に「英語」以外が選択された場合、SAP NetWeaver 用 SAP連携コネクタが正常に動作しない。 |

小 |

「英語」 以外が選択された場合、必ず発生する。 |

13 |

4.1.0-1

/ 4.0.0-1

|

SQLServer モニタにおいて、DB のキャッシュに SQL 文が残り、性能に問題が出る可能性がある。 |

小 |

監視レベル 2 の場合に発生する。 |

14 |

4.1.0-1

/ 4.0.0-1

|

SQLServer モニタで、監視ユーザ名を不正にした場合などの警告になるべきケースが、監視異常になる。 |

小 |

監視パラメータの設定不備がある場合に発生する。 |

15 |

4.1.0-1

/ 4.0.0-1

|

ODBC 監視で、監視ユーザ名を不正にした場合などの警告になるべきケースが、監視異常になる。 |

小 |

監視パラメータの設定不備がある場合に発生する。 |

16 |

4.1.0-1

/ 4.0.0-1

|

Database Agent で監視異常時の回復動作が 30 秒遅れて実行される。 |

小 |

回復動作実行時に必ず発生する。 |

17 |

4.1.0-1

/ 4.0.0-1

|

Database Agent で、clptoratio コマンドによるタイムアウト倍率の設定が効かない。 |

小 |

必ず発生する。 |

18 |

4.1.0-1

/ 4.0.0-1

|

クラスタサスペンドがタイムアウトすることがある。 |

中 |

クラスタリジューム処理中にクラスタサスペンド操作を実行した場合に、稀に発生する。 |

19

|

4.1.0-1

/ 4.0.0-1

|

手動起動に設定されたフェイルオーバグループのフェイルオーバ時に、フェイルオーバ元で起動されていなかったグループリソースが、フェイルオーバ先で起動されることがある。

|

小

|

下記の状態遷移により発生する。

|

20 |

4.1.0-1

/ 4.0.0-1

|

clpstat コマンドで、クラスタ停止処理中のステータスが適切に表示されない。 |

小 |

クラスタ停止実行直後からクラスタ停止完了までの間で clpstat コマンドを実行した場合に発生する。 |

21 |

4.1.0-1

/ 4.0.0-1

|

停止処理の完了していないグループリソースのステータスが停止状態となる場合がある。

|

中

|

停止処理が失敗した状態のグループリソースに対し、下記の操作を行うと発生する場合がある。

|

22 |

4.1.0-1

/ 4.0.0-1

|

シャットダウン監視によるサーバリセットよりも前にフェイルオーバが開始されることがある。 |

大 |

システム高負荷により、シャットダウン監視の動作が遅延した場合に、稀に発生する。 |

23 |

4.1.0-1

/ 4.0.0-1

|

強制停止機能の設定変更時に、適切な反映方法 (クラスタのサスペンド / リジューム) が実行されない場合がある。 |

小 |

仮想マシン強制停止設定の初回反映時に発生する。 |

24 |

4.1.0-1

/ 4.0.0-1

|

クラスタプロパティの 「ログの通信方法」 の設定変更が反映されないことがある。 |

小 |

クラスタの初回構築時に、「ログの通信方法」 を「UNIXドメイン」 以外へ変更した場合に発生する。 |

25 |

4.1.0-1

/ 4.0.0-1

|

exec リソース、カスタムモニタリソースのスクリプトログにて下記の問題が発生する。

・非同期スクリプトのログ出力時刻がすべてプロセス終了時刻になる。

・ログの一時保存ファイルが残存することがある。

|

小 |

スクリプトのログローテート機能が有効である場合に発生する。 |

26 |

4.1.0-1

/ 4.0.0-1

|

ミラーディスクリソースおよびハイブリッドディスクリソースの作成時に 「初期ミラー構築を行わない」 を指定すると最初のミラー復帰が必ずフルコピーになる。 |

小 |

「初期ミラー構築を行わない」 を指定すると必ず発生する。 |

27 |

4.1.0-1

/ 4.0.0-1

|

ミラーディスク / ハイブリッドディスクの起動 / 停止 / 監視処理に遅延が発生する。 |

小 |

ミラーディスクリソース / ハイブリッドディスクリソース数の合計がおよそ16個以上の場合に発生する。 |

28 |

4.1.0-1

/ 4.0.0-1

|

ディスクモニタリソースにおいて、タイムアウトを検出しても異常とならず警告となる。 |

中 |

ディスクモニタリソースでタイムアウトを検出した場合に発生することがある。 |

29 |

4.1.1-1

/ 4.1.0-1

|

Cluster WebUI の設定モードへの切替に失敗する。 |

小 |

特定のブラウザから HTTPS で Cluster WebUI に接続すると発生する。 |

30 |

4.1.1-1

/ 4.1.0-1

|

ミラーディスクリソースまたはハイブリッドディスクリソースにて非同期モードを使用している場合、現用系サーバダウンおよび差分コピーが実行されると現用系と待機系のデータに不整合が発生する。 |

大 |

現用系サーバダウンおよび差分コピーが実行されると発生することがある。 |

31 |

4.1.1-1

/ 4.1.0-1

|

LVMの論理ボリュームをミラーディスクリソースまたはハイブリッドディスクリソースのデータパーティションに指定した場合、初期ミラー構築およびミラー復帰が完了しない。 |

大 |

LVMの論理ボリュームをデータパーティションに指定すると発生する。 |

32 |

4.1.2-1

/ 4.1.0-1

|

ネットワーク警告灯の設定時に、以下の項目の設定値が構成情報に保存されない。

- ネットワーク警告灯を使用する

- サーバ起動時に音声ファイルの再生を行う

- 音声ファイル番号

- サーバ停止時に音声ファイルの再生を行う

- 音声ファイル番号

|

小 |

ネットワーク警告灯を設定する場合に必ず発生する。 |

33 |

4.2.2-1

/ 4.0.0-1~4.2.0-1

|

ミラー再構築中に残り時間が正しく表示されない場合がある。 |

小 |

ミラー再構築中の残り時間が1時間以上の場合に発生する。 |

34 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

ミラー復帰中に、ミラーディスクモニタリソース/ハイブリッドディスクモニタリソースのステータスが警告にならないことがある。 |

小 |

ミラーディスクモニタリソース/ハイブリッドディスクモニタリソースのステータスが異常の状態からミラー復帰を開始した場合に発生する。 |

35 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

clpstatコマンドにて以下の不正なエラーメッセージが表示されることがある。

Could not connect to the server.

Internal error.Check if memory or OS resources are sufficient.

|

小 |

クラスタ起動直後にclpstatコマンドを実行した場合に、稀に発生する。 |

36 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

構成情報の反映時に不要な操作(WebManagerサーバ再起動)が表示されることがある。 |

小 |

反映方法に「クラスタシャットダウン・再起動」が必要な設定変更と、「WebManagerサーバ再起動」が必要な設定変更を同時に行った場合に発生する。 |

37 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

グループおよびグループリソースのカレントサーバ情報に不整合が生じることがある。 |

中 |

手動フェイルオーバを設定している場合、インタコネクトの断線復帰後に稀に発生する。 |

38 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

構成情報の反映時に不要な操作(サスペンド/リジューム)が要求されることがある。 |

小 |

自動登録されたモニタリソースのプロパティを参照した場合に発生することがある。 |

39 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

マルチターゲットモニタリソースにて、異常しきい値および警告しきい値の設定通りに動作しないことがある。 |

小 |

|

40 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

ダイナミックDNSリソースの活性に失敗することがある。 |

中 |

リソース名とホスト名の合計が124バイト以上の場合に稀に発生する。 |

41 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

Cluster WebUIで、ミラーディスクアクションが正常に動作しないことがある。 |

小 |

ミラーエージェントポート番号を変更した場合に発生する。 |

42 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

clpstat コマンドで不正な項目名が表示されることがある。

|

小 |

ディスクハートビートリソースが存在する環境で clpstat --hb --detail を実行した場合に発生する。 |

43 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

rpcbind サービスが意図せず起動することがある。 |

小 |

ログ収集時に発生することがある。 |

44 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

clusterpro_evtサービスがnfsより先に起動することがある。 |

小 |

init.d環境において発生する。 |

45 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

CLUSTERPRO Web Alertサービスが異常終了することがある。 |

小 |

特定の条件によらず、ごく稀に発生することがある。 |

46 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

仮想マシン強制停止機能のタイムアウト設定が機能しないことがある。 |

中 |

仮想マシン強制停止機能を使用し、強制停止処理に時間を要する場合に発生する。 |

47 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

クラスタ再起動時、グループが起動しないことがある。 |

中 |

クラスタ再起動時、現用系のグループ停止処理中に、待機系サーバが先行して再起動した場合に稀に発生することがある。 |

48 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

サーバの停止処理に時間がかかることがある。 |

小 |

クラスタ停止時にごく稀に発生することがある。 |

49 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

グループ、リソースの非活性に失敗した場合でも非活性成功のアラートが出力されることがある。 |

小 |

緊急シャットダウン時に発生することがある。 |

50 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

サーバダウン検出時にグループがフェイルオーバしないことがある。 |

中 |

サーバ起動時の内部情報の同期処理中にサーバダウンを検出した場合に発生することがある。 |

51 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

PIDモニタリソースで、監視対象のプロセスが消滅した場合に異常検出できない場合がある。 |

小 |

監視インターバルの間に、消滅したプロセスと同じプロセスIDで新規にプロセスが起動された場合。 |

52 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

プロセスリソースモニタリソースの[オープンファイル数の監視(カーネル上限値)]で、設定値通りに異常検出が行われない。 |

小 |

[オープンファイル数の監視(カーネル上限値)]をオンにした場合、必ず発生する。 |

53 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

EXECリソースが、停止時に他のプロセスを強制終了させてしまうことがある。 |

中 |

EXECリソースで以下の条件をすべて満たす場合に発生する。

|

54 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

ミラーディスクリソースおよびハイブリッドディスクリソースで、活性側サーバのミラーディスク状態が異常になる。 |

大 |

以下の遷移が実行されると発生する。

|

55 |

4.2.0-1

/ 4.0.0-1~4.1.2-1

|

ボリュームマネージャーモニタリソースの監視対象がLVMミラーである場合に、LVMミラーの縮退状態が監視異常となる。

|

小 |

LVMミラーが縮退状態になると発生する。 |

56 |

4.2.2-1

/ 4.1.0-1~4.2.0-1

|

ミラー通信専用インタコネクトのIPアドレスを変更できない。 |

小 |

クラスタ構築時、優先順位が低いサーバを優先順位が高いサーバより先に追加した場合に発生する。 |

57 |

4.2.2-1

/ 4.2.0-1

|

クラスタ構成情報チェック機能で、ポート番号の特定範囲の確認が正しく行われない。 |

小 |

チェック対象のポート番号が下記の範囲である場合に発生する。

エフェメラルポート最大値 < 対象ポート番号 <= ポート番号最大値(65535)

|

58 |

4.2.2-1

/ 4.2.0-1

|

クラスタ構成情報チェック機能で、AWSCLIコマンドのチェックが失敗する。 |

小 |

以下のグループリソースが設定された環境でクラスタ構成情報チェックを実行した場合に発生する。

・AWS Elastic IPリソース

・AWS 仮想IPリソース

・AWS DNS リソース

|

59 |

4.2.2-1

/ 4.2.0-1

|

クラスタ起動後にクラスタ構成情報チェックを実行すると、フローティングIPリソースおよび仮想IPリソースのチェックが失敗する。 |

小 |

フローティングIPリソースおよび仮想IPリソースを起動した状態で、クラスタ構成情報チェックを実行した場合に発生する。 |

60 |

4.2.2-1

/ 4.1.0-1~4.2.0-1

|

Oracle Clusterware 同期管理モニタリソースが起動しない。 |

小 |

Oracle Clusterware 同期管理モニタリソースの設定時、回復動作を既定値から変更していない場合に発生する。 |

61 |

4.2.2-1

/ 4.0.0-1~4.2.1-1

|

Cluster WebUI の細かな不具合を修正しました。 |

小 |

Cluster WebUI 使用時に発生する。 |

62 |

4.3.0-1

/ 4.0.0-1~4.2.2-1

|

アラート送信先設定の [Alert Extension] が使用できない。 |

小 |

アラート送信先設定に [Alert Extension] を選択した場合、必ず発生する。 |

63 |

4.3.0-1

/ 4.2.0-1~4.2.2-1

|

フェイルオーバグループが起動しないサーバ上で、そのグループに関するクラスタ構成チェックを行っている。 |

小 |

起動サーバの設定で、フェイルオーバグループが起動しないサーバを設定した場合に発生する。 |

64 |

4.3.0-1

/ 1.0.0-1~4.2.2-1

|

未使用のサーバが設定されているカーネルモード LAN ハートビートに不要なパケットが送信される。 |

小 |

カーネルモード LAN ハートビートに未使用サーバが設定されている場合に必ず発生する。 |

65 |

4.3.0-1

/ 4.1.0-1~4.2.2-1

|

サーバシャットダウン時にシャットダウンストール監視によるリセットが不必要に実行されることがある。 |

小 |

グループリソースの停止失敗やNP解決処理によるサーバシャットダウンを実行時に発生する場合がある。 |

66 |

4.3.0-1

/ 4.2.0-1~4.2.2-1

|

CLUSTERPRO Information Base サービスが異常終了することがある。 |

小 |

OSのリソース不足時にごく稀に発生する。 |

67 |

4.3.0-1

/ 4.1.0-1~4.2.2-1

|

未使用のサーバが設定されているインタコネクトに不要なデータ転送用のパケットが送信される。 |

小 |

インタコネクトに未使用サーバが設定されている場合に必ず発生する。 |

68 |

4.3.0-1

/ 4.2.0-1~4.2.2-1

|

Cluster WebUI で設定モードに遷移できなくなる。 |

小 |

OS認証方式によるパスワード設定を行い、操作権がないグループのみで設定反映した場合に発生する。 |

69 |

4.3.0-1

/ 4.2.0-1~4.2.2-1

|

Cluster WebUI の[ステータス]画面にある[サーバサービス開始]ボタンが有効にならない。 |

小 |

Cluster WebUI を接続しているサーバのサービス停止を行った場合に発生する。 |

70 |

4.3.0-1

/ 4.1.0-1~4.2.2-1

|

Cluster WebUI の設定モードの [リソースのプロパティ]-[依存関係]タブ で依存するリソースを削除した際に表示が不正になる場合がある。 |

小 |

依存するリソースを削除した場合に発生する。 |

71 |

4.3.0-1

/ 4.0.0-1~4.2.2-1

|

Cluster WebUI の[ミラーディスク]画面でミラーディスクリソースをクリックした際に、ローディングアイコンが表示されたままになる。 |

小 |

ミラーディスクリソースをクリックした際のミラー情報を取得する通信が失敗した場合に発生する。 |

72 |

4.3.0-1

/ 4.0.0-1~4.2.2-1

|

Cluster WebUI で[ダッシュボード]画面のアラートログと[ミラーディスク]画面が表示されない場合がある。 |

小 |

ハイブリットディスクリソースの情報取得に失敗した場合に発生する。 |

73 |

4.3.0-1

/ 4.1.0-1~4.2.2-1

|

Cluster WebUI でグループリソースおよびモニタリソース追加時に編集したスクリプトファイルが正しいパスに保存されない。 |

小 |

グループリソースおよびモニタリソースの追加画面でスクリプトファイル編集後に前画面に戻り、グループリソース名およびモニタリソース名を変更した場合に発生する。 |

74 |

4.3.0-1

/ 4.1.0-1~4.2.2-1

|

Cluster WebUIでBMCが設定されているクラスタにサーバを追加した場合、誤ったクラスタ構成情報が生成される。 |

小 |

BMCを設定しているクラスタにサーバを追加した場合に発生する。 |

75 |

4.3.0-1

/ 4.1.0-1~4.2.2-1

|

Cluster WebUI の [グループのプロパティ]-[情報]タブにある [サーバグループ設定を使用する]をオンからオフに変更した際に、[属性]タブの表示内容に誤りが生じる。 |

小 |

[属性]タブのフェイルオーバ属性を「サーバグループ内のフェイルオーバポリシーを優先する」に設定した状態で、「サーバグループ設定を使用する」をオンからオフに変更した場合に発生する。 |

76 |

4.3.0-1

/ 4.1.0-1~4.2.2-1

|

Cluster WebUI の [モニタリソースのプロパティ]-[監視(共通)]タブで、[監視タイミング]-[対象リソース] の [参照]ボタンが押下できない。 |

小 |

[監視タイミング] を常時監視から活性時監視に変更して登録したモニタリソースの[モニタリソースのプロパティ]を開いた場合に発生する。 |

77 |

4.3.0-1

/ 4.2.0-1~4.2.2-1

|

Cluster WebUI Offlineで[サーバ]-[サーバの追加]ボタンを押した場合に、エラーメッセージが表示されサーバ追加ができない。 |

小 |

[サーバ]-[サーバの追加]ボタンを押した場合に発生する。 |

78 |

4.3.0-1

/ 4.1.0-1~4.2.2-1

|

Cluster WebUI の設定モードで現在のクラスタ構成を破棄するメッセージが誤ったタイミングで出力される。 |

小 |

構成情報を変更せずに以下の操作を行った後、設定のインポートボタンまたは設定の取得ボタンを押下した場合に発生する。

・設定のエクスポート

・設定反映を途中でキャンセル

・クラスタ構成情報チェック

|

79 |

4.3.0-1

/ 4.1.0-1~4.2.2-1

|

Cluster WebUI の設定モードで不要な設定値チェックが行われる。 |

小 |

ミラーディスクリソース/ハイブリッドディスクリソースを設定していない環境で[CPIOタイムアウト]より[HBタイムアウト]を短くした場合に発生する。 |

80 |

4.3.0-1

/ 4.1.0-1~4.2.2-1

|

警告灯が設定されている環境にサーバを追加した場合、構成情報に不要な情報が保存される。 |

小 |

警告灯を設定している環境にサーバを追加した場合に発生する。 |

81 |

4.3.0-1

/ 4.1.0-1~4.2.2-1

|

システムモニタリソースで、9文字以上のモニタリソース名を指定すると監視異常を検出しない。 |

小 |

9文字以上のモニタリソース名を指定した場合に必ず発生する。 |

82 |

4.3.0-1

/ 4.1.0-1~4.2.2-1

|

プロセスリソースモニタリソースで、9文字以上のモニタリソース名を指定すると監視異常を検出しない。 |

小 |

9文字以上のモニタリソース名を指定した場合に必ず発生する。 |

83 |

4.3.0-1

/ 2.1.0-1~4.2.2-1

|

Cluster WebUI の[ステータス]画面で、HTTPモニタリソースの詳細プロパティに表示される[プロトコル]の表示に誤りがある。 |

小 |

必ず発生する。 |

84 |

4.3.0-1

/ 4.1.0-1~4.2.2-1

|

Witnessハートビートリソースのタイムアウト検出が遅れることがある。 |

中 |

Witnessサーバとの通信が途切れたサーバで発生する。 |

85 |

4.3.0-1

/ 4.2.0-1~4.2.2-1

|

グループの自動起動が無効に設定されている環境でサーバダウンを検出すると、停止済のフェイルオーバグループが誤って起動されることがある。 |

小 |

クラスタ起動後に一度も起動されていないフェイルオーバグループが存在する場合に発生する。 |

86 |

4.3.2-1

/ 4.0.0-1~4.3.0-1

|

グループ移動が失敗した場合に、clprc プロセスが異常終了しシャットダウンすることがある。 |

中 |

グループ移動が失敗した場合に発生することがある。 |

87 |

4.3.2-1

/ 4.2.0-1~4.3.0-1

|

AWS DNSリソースに設定したリソースレコードセット名が有効にならないことがある。 |

小 |

AWS DNSリソースを使用している場合に稀に発生することがある。 |

88 |

4.3.2-1

/ 4.3.0-1

|

clpcfsetコマンドでディスクハートビートリソースを2つ以上追加できない。 |

小 |

常に発生する。 |

89 |

4.3.2-1

/ 3.0.0-1~4.3.0-1

|

ディスクモニタリソースの監視方法「TUR」で、ターゲットデバイスの消失に対し監視異常を検出しない。 |

小 |

監視方法を「TUR」に指定したディスクモニタリソースのターゲットデバイスがOSから消失した場合に発生する。 |

90 |

4.3.2-1

/ 3.0.0-1~4.3.0-1

|

clpmdstatおよびclphdstatの表示結果が不正になることがある。 |

小 |

クラスタパーティションデバイス名またはデータパーティションデバイス名のパス名長が80文字を超える場合に発生する。 |

91 |

4.3.2-1

/ 4.1.0-1~4.3.0-1

|

MySQLモニタリソースおよびOracleモニタリソースで、一度監視タイムアウトが発生すると、復旧後も監視異常を誤検出する。 |

中 |

監視処理がタイムアウトした場合に発生する。 |

92 |

4.3.2-1

/ 3.3.0-1~4.3.0-1

|